Microsoft Copilot hatte Zugriff auf vertrauliche E-Mails von Unternehmen - ohne Erlaubnis.

Microsoft hat eingeräumt, dass ein Fehler in Microsoft 365 Copilot dem KI-Assistenten versehentlich Zugriff auf vertrauliche E-Mails gewährt hat.

Laut Bleeping Computer betrifft ein Servicebericht über den Fehler (getracked als CW1226324), der ursprünglich am 21. Januar entdeckt wurde, die Copilot-Chatfunktion “Work Tab”. Diese ermöglicht es der KI, E-Mails in den Ordnern “Gesendet” und “Entwürfe” der Benutzer zu lesen und zusammenzufassen. Besorgniserregend dabei ist, dass die KI Zugang zum Lesen und Zusammenfassen von E-Mails hatte, die mit einer Vertraulichkeitskennzeichnung versehen waren, die ausdrücklich dafür gedacht ist, dass automatisierte Tools keinen Zugang haben.

Microsoft bestätigte das Problem gegenüber Bleeping Computer:

Der Microsoft 365 Copilot ‘work tab’ Chat fasst E-Mail-Nachrichten zusammen, auch wenn diese E-Mail-Nachrichten mit einem Sensitivitätslabel versehen sind und eine DLP-Richtlinie konfiguriert ist.”

Der Tech-Gigant aus dem Silicon Valley teilte außerdem mit, dass ein Code-Problem dazu führt, dass Elemente in den Ordnern “Gesendet” und “Entwürfe” von Copilot erfasst werden, obwohl vertrauliche Kennzeichnungen vorhanden sind. Am Mittwoch erklärte Microsoft, dass es den Fix überwacht und einige Nutzer kontaktiert, um sich zu vergewissern, dass die Korrektur funktioniert.

Risiko nicht wert

Microsoft hat die Einführung seiner künstlichen Intelligenz, Copilot, in alle Microsoft 365-Apps vorangetrieben - nicht nur für den privaten Gebrauch, sondern auch für Unternehmen. Im September 2025 wurde Copilot Chat, Microsofts KI-gestützter Chat, der es Nutzern ermöglicht, mit KI-Agenten zu interagieren, in Excel, Word, Outlook, PowerPoint und OneNote für Microsoft 365 Geschäftskunden eingeführt. Jetzt, nur vier Monate später, hat ein Fehler die sensiblen Daten von Microsoft 365-Nutzern gefährdet.

Während der Einsatz von KI-Assistenten wie Copilot Chat von den Tech-Giganten weltweit angepriesen wird, um die Produktivität zu steigern und Arbeitsabläufe zu beschleunigen, ist klar, dass neue und sich entwickelnde KI-Technologien zu einem extremen Sicherheits- und Datenschutzrisiko werden können - insbesondere für Unternehmen, die sensible Daten schützen müssen.

Preiserhöhungen, KI und ein schlimmer Fehler: E-Mail-Vertraulichkeit adieu!

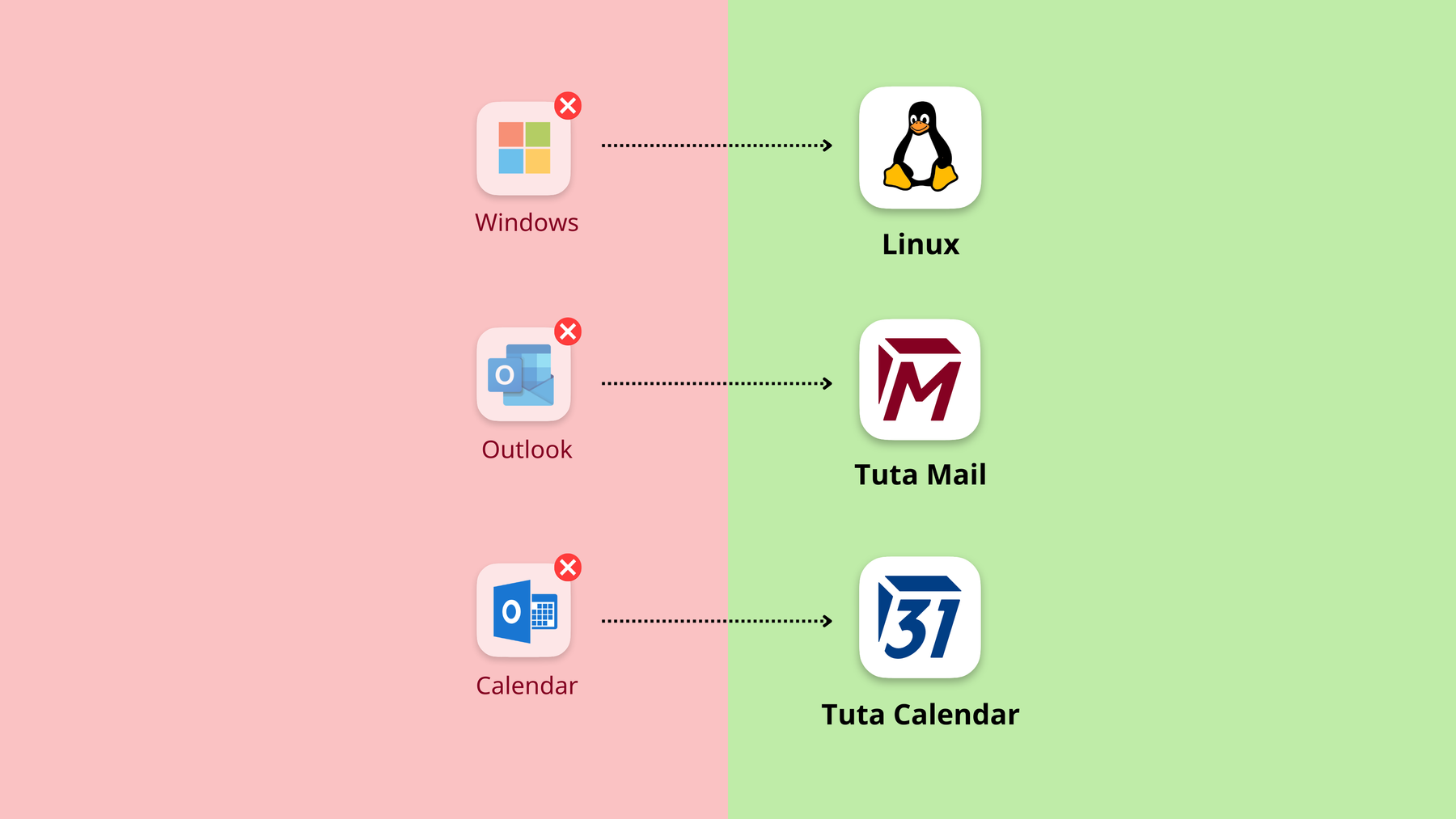

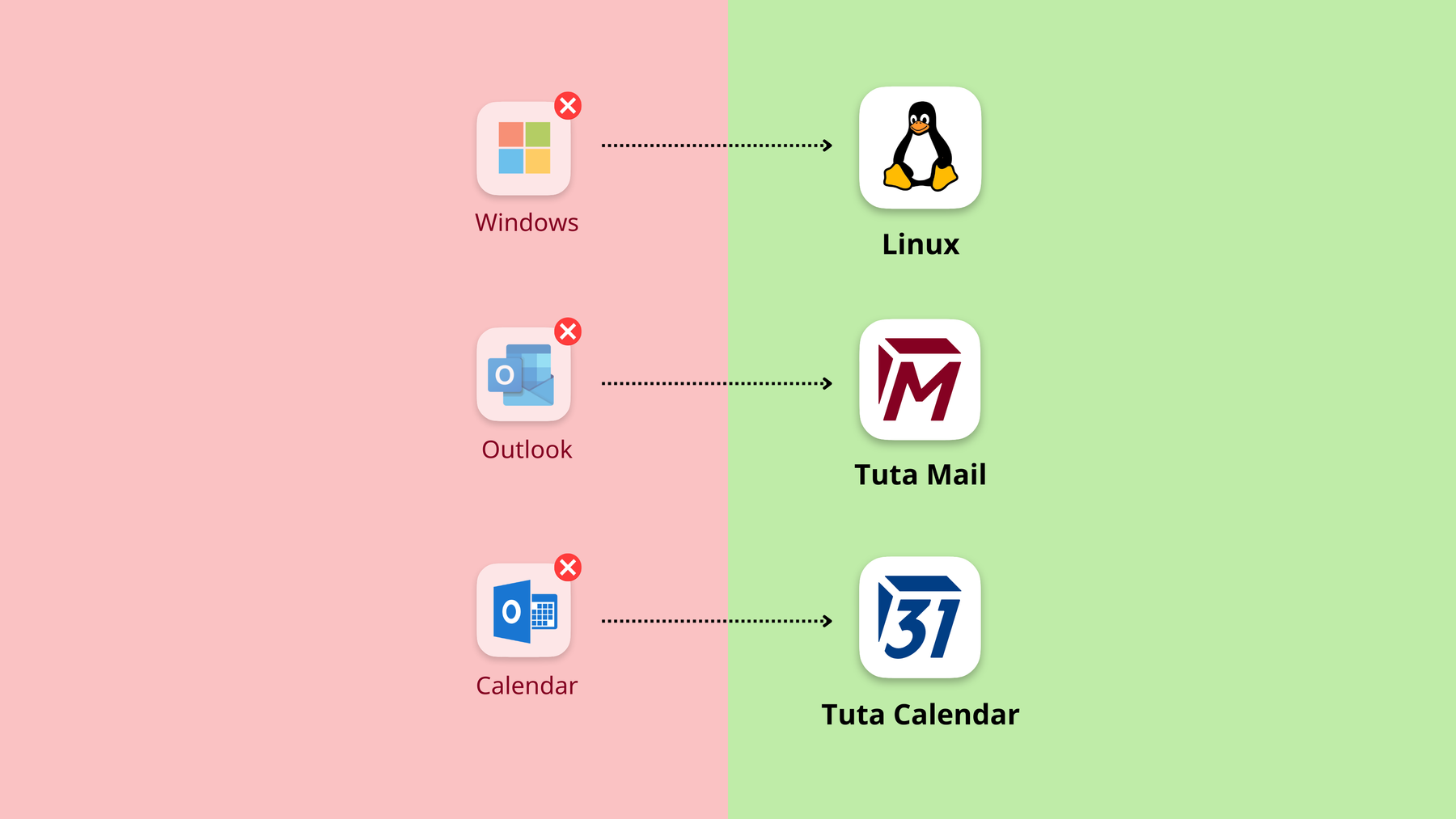

Viele Unternehmen verwenden heute Microsoft Outlook - vor allem, weil es mit den Office-Tools von Microsoft wie Word und Excel gebündelt ist. Aber die jüngsten Entwicklungen zeigen, dass der Wechsel zu Alternativen, insbesondere für E-Mails, immer attraktiver wird.

-

Im Januar 2026 ermöglichte ein Fehler Copilot Chat, E-Mails zusammenzufassen, obwohl Sensitivitätskennzeichnungen und DLP-Richtlinien konfiguriert waren.

-

Im Jahr 2025 kündigte Microsoft massive Preiserhöhungen für Microsoft 365 an, die im Juli 2026 beginnen sollten.

-

Im September 2025 führte Microsoft seinen Copilot Chat in Excel, Word, Outlook, PowerPoint und OneNote für zahlende Microsoft 365-Geschäftskunden ein.

Eines wird aus all dem deutlich: Wenn Ihr Unternehmen Microsoft 365 nutzt, ist es an der Zeit, die Anbieterbindung zu beenden und Ihre vertraulichen Informationen zu schützen. Zum Glück gibt es hervorragende Alternativen zu Microsoft-Produkten.

Es ist an der Zeit, die Herstellerbindung zu beenden

Dies ist weder das erste noch das letzte Sicherheitsproblem, mit dem Microsoft zu kämpfen hat.

-

Im Jahr 2024 forderte die US-Regierung Microsoft auf, seine Sicherheitslücken zu schließen, bevor neue Funktionen hinzugefügt werden, nachdem China die E-Mail-Server von Microsoft gehackt hatte.

-

Im Jahr 2025 wurden Unternehmen davor gewarnt, auf das “Neue Outlook” umzusteigen, da es die Datenschutzgesetze, die Unternehmen einhalten müssen, nicht einhält.

-

Im Jahr 2025 löste Microsoft den Trend zur digitalen Souveränität in Europa aus, nachdem der Anwalt von Microsoft in Frankreich bestätigt hatte, dass die US-Regierung ohne Vorwarnung auf alle bei Microsoft gehosteten Daten zugreifen kann, auch wenn diese in europäischen Rechenzentren gespeichert sind.

Mit der Integration und der schnellen Entwicklung von Copilot in Microsoft 365 bleiben die Daten von Einzelpersonen und Unternehmen weiterhin gefährdet.

Die Aufdeckung dieses Bugs, nur wenige Monate nach der Einführung von Copilot in den Microsoft 365 Business-Abonnements, macht deutlich, warum KI-Assistenten nicht in E-Mails gehören und wie wichtig es ist, Ende-zu-Ende-verschlüsselte E-Mails wie Tuta Mail zu verwenden.