Comment empêcher LinkedIn d'utiliser vos données pour entraîner l'IA !

Si vous n'avez pas désactivé manuellement l'intelligence artificielle de LinkedIn, celle-ci pourrait utiliser votre CV et les informations de votre profil pour former l'intelligence artificielle de Microsoft et Cie. Et non, vous n'avez pas choisi de participer. Agissez et mettez fin à cette pratique dès maintenant.

Comment empêcher LinkedIn d’utiliser vos données pour entraîner l’IA ?

Si vous n’avez pas eu l’occasion de vous désinscrire avant le 3 novembre 2025, vous pouvez encore le faire en suivant les étapes ci-dessous. Notez que cela empêche l’utilisation des données futures, mais ne supprime pas les données qui sont déjà utilisées pour former des modèles d’IA.

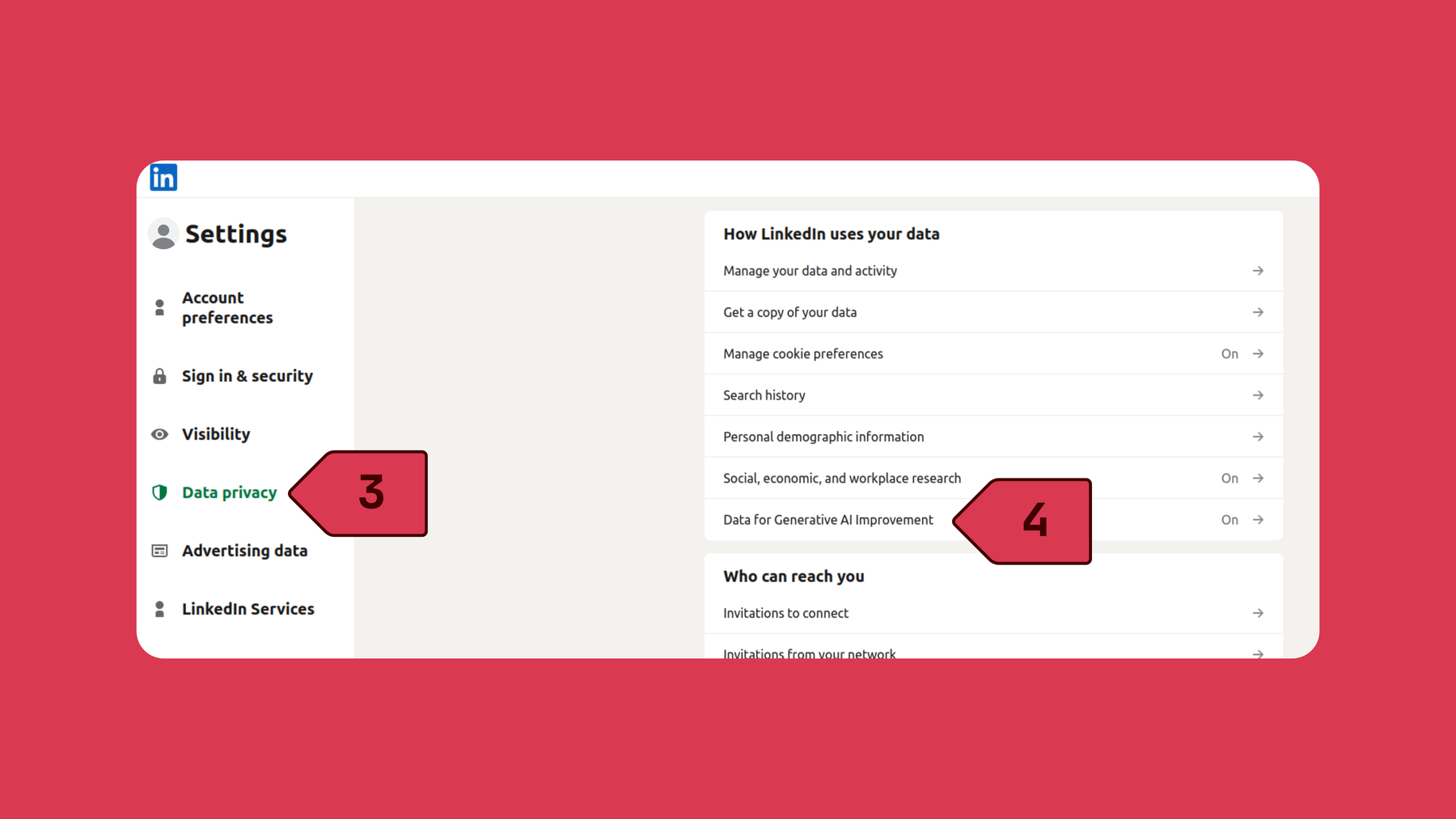

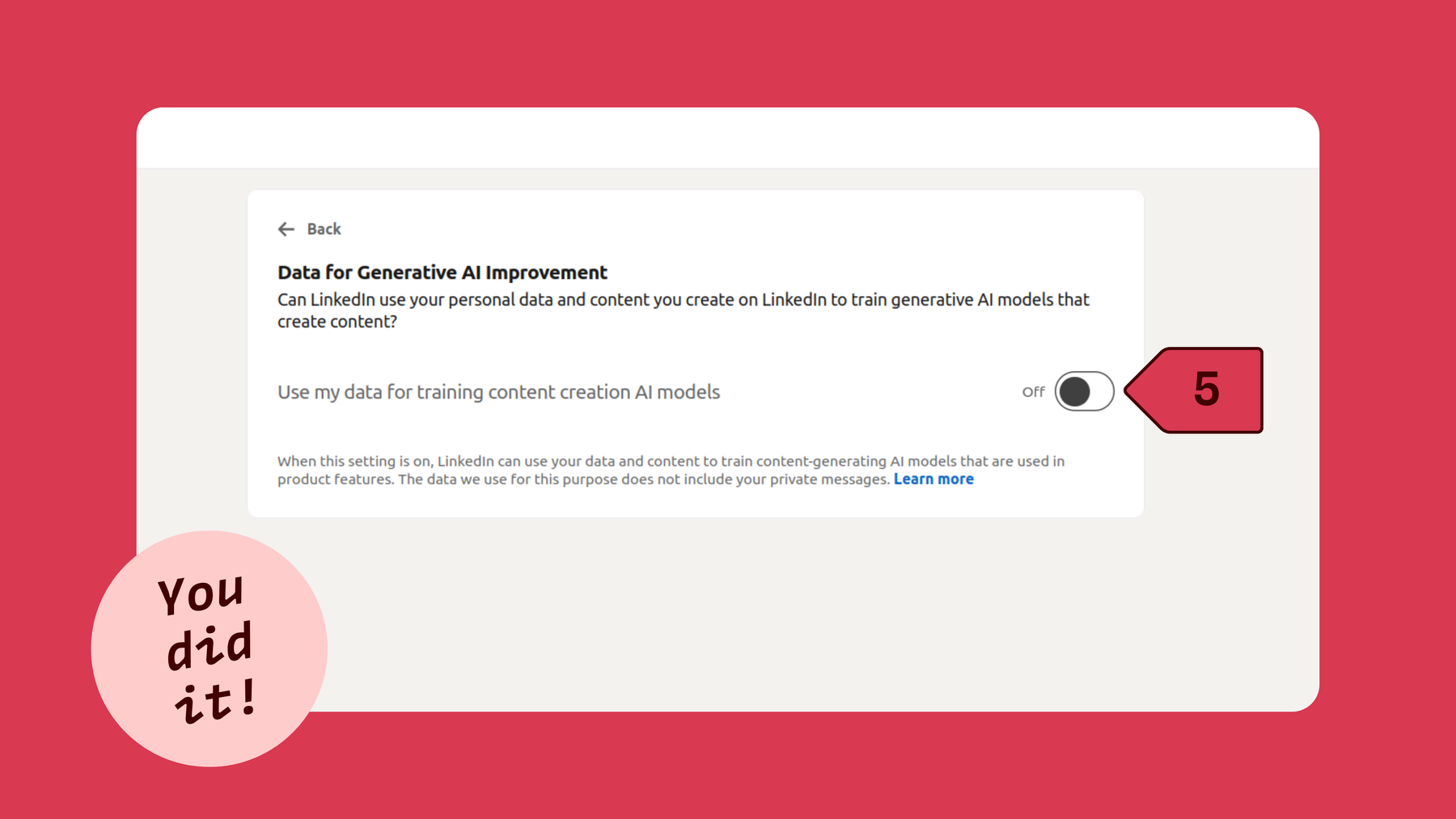

- Connectez-vous à votre compte LinkedIn 2. Cliquez sur votre photo de profil 3. Cliquez sur Paramètres et confidentialité 4. Sélectionnez Confidentialité des données 5. Cliquez sur Données pour l’amélioration de l’IA générative 6. À côté de Use my data for training content creation AI models, cliquez pour désactiver la case.

Lien rapide pour se désinscrire: Cliquez sur ce lien pour empêcher LinkedIn d’utiliser vos données pour l’IA.

LinkedIn est la prochaine grande entreprise technologique qui prévoit d’exploiter discrètement les données des utilisateurs européens pour former des modèles d’IA. L’année dernière , le 18 septembre, LinkedIn a annoncé qu’** à partir du 3 novembre 2025, les données de ses utilisateurs dans l’UE, l’EEE et la Suisse, remontant jusqu’à 2003, seraient utilisées pour entraîner ses modèles d’IA et ceux de ses filiales.** Cela signifie que des informations telles que vos antécédents professionnels, votre CV et votre engagement sur LinkedIn pourraient être collectées et utilisées pour former des modèles d’IA. Plutôt que de donner la possibilité de choisir explicitement d’accepter ou de refuser ce traitement de données, LinkedIn a choisi d’accepter tout le monde par défaut (comme il l’a fait en 2024 dans d’autres régions), affirmant que le traitement des données est un intérêt légitime en vertu du GDPR de l’UE. Cette annonce du géant technologique, qui appartient à Microsoft et qui est poursuivi en Australie pour avoir trompé des millions de clients en leur faisant payer une augmentation de 45 % pour des modules complémentaires d’IA, et qui a également été critiqué pour avoir pris des captures d’écran toutes les quelques secondes via Microsoft Recall, a inquiété de nombreuses personnes sur la façon dont leurs données sont utilisées et comment LinkedIn décide simplement d’utiliser les données, au lieu de les demander poliment. Désormais, les utilisateurs doivent agir ou rester sur la touche pendant que leurs données sont utilisées de manière abusive.

Grande victoire pour LinkedIn : feu vert à l’utilisation des données pour l’entraînement à l’IA dans l’UE, l’EEE et la Suisse

En novembre 2024, LinkedIn a commencé à utiliser les données personnelles d’utilisateurs du monde entier pour entraîner ses modèles d’IA générative. À l’époque, les Européens se sentaient en sécurité, s’appuyant sur le GDPR qui semblait protéger leurs données contre les abus. En effet, à l’époque, les données des utilisateurs résidant dans l’UE, l’EEE et la Suisse étaient exclues. Mais comme annoncé, depuis la fin de l’année 2025, LinkedIn utilise également les données des utilisateurs de ces régions pour l’entraînement à l’IA - une victoire pour LinkedIn, mais une grande perte pour la vie privée de ses utilisateurs.

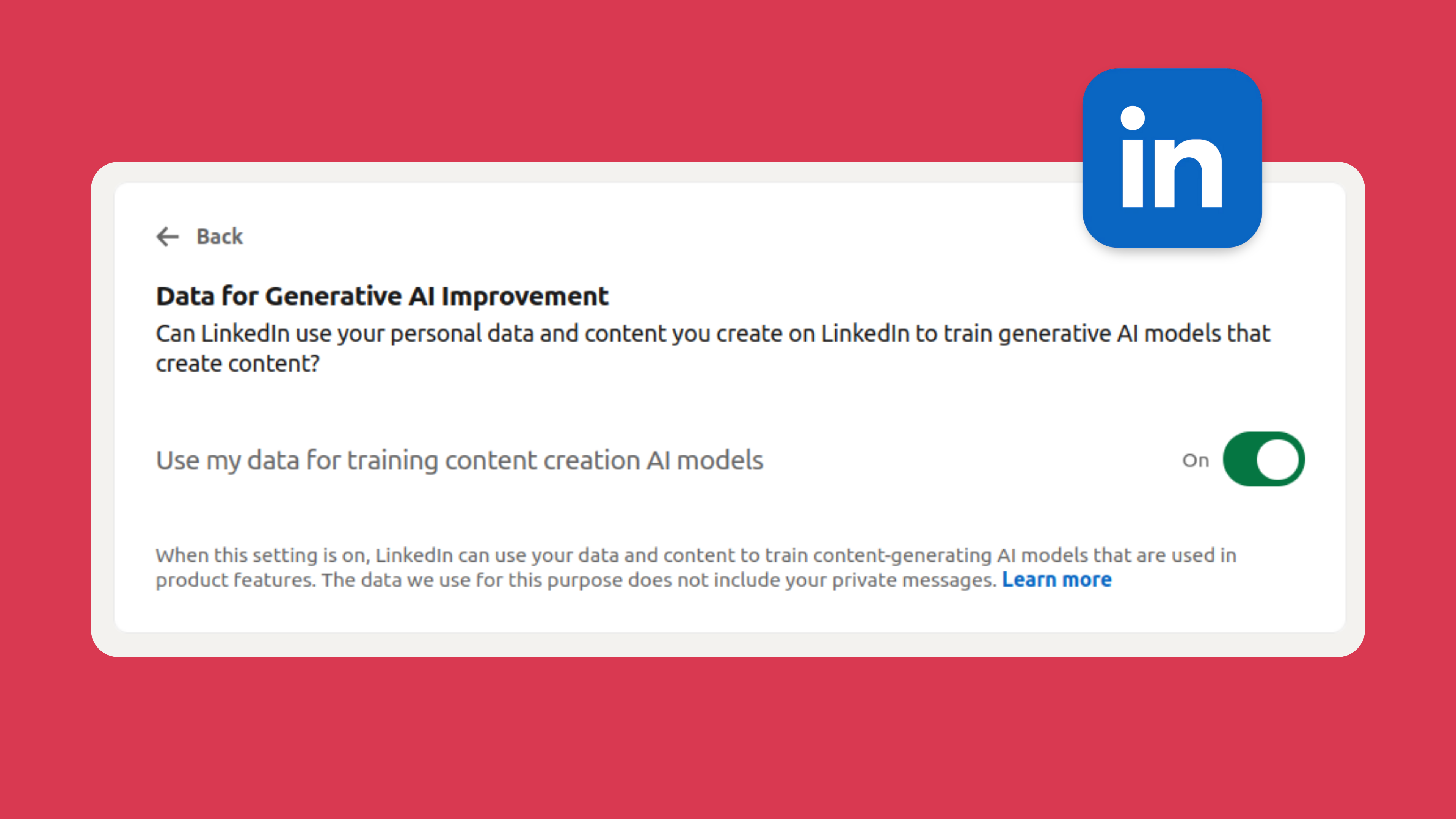

En raison de cette annonce alarmante, les experts en protection de la vie privée de l’UE ont averti les utilisateurs qu’ils devaient se rendre manuellement dans les paramètres de leur compte LinkedIn et désactiver l’option “Données pour l’amélioration générative de l’IA”.

Quelles sont les données collectées par LinkedIn pour l’entraînement à l’IA ?

Si vous n’avez pas désactivé manuellement l’utilisation de vos données pour l’entraînement à l’IA avant le 3 novembre 2025, toutes les données remontant à 2003, que nous avons énumérées ci-dessous, peuvent être utilisées pour entraîner les modèles d’IA de LinkedIn et de ses filiales. Si vous ne l’avez pas encore fait, vous pouvez toujours vous désinscrire, mais les données collectées avant votre désinscription ne seront pas supprimées du modèle d’IA de LinkedIn, ce qui signifie que vos données personnelles resteront en permanence dans les ensembles de données d’entraînement.

-

Toutes vos données de profil : noms, photo de profil, emplois actuels et passés, formation, compétences, localisation, mentions, publications, brevets et recommandations.

-

Votre contenu : les messages que vous avez écrits ou partagés, les articles, les commentaires, les contributions et les réponses aux sondages.

-

Vos données professionnelles : vos CV, les emplois auxquels vous avez postulé, vos données de candidature et vos réponses aux questions de sélection.

-

Vos données de groupe : activités dans les groupes et messages.

-

Vos commentaires : les commentaires que vous fournissez, y compris les réponses et les évaluations.

Remarque : LinkedIn a déclaré que vos messages privés, vos données de connexion, vos méthodes de paiement et vos données hautement sensibles seront exclus de la collecte de données.

Comment refuser que LinkedIn utilise vos données pour alimenter ses projets d’IA sur n’importe quel appareil ?

Comment se désinscrire de LinkedIn AI sur iPhone

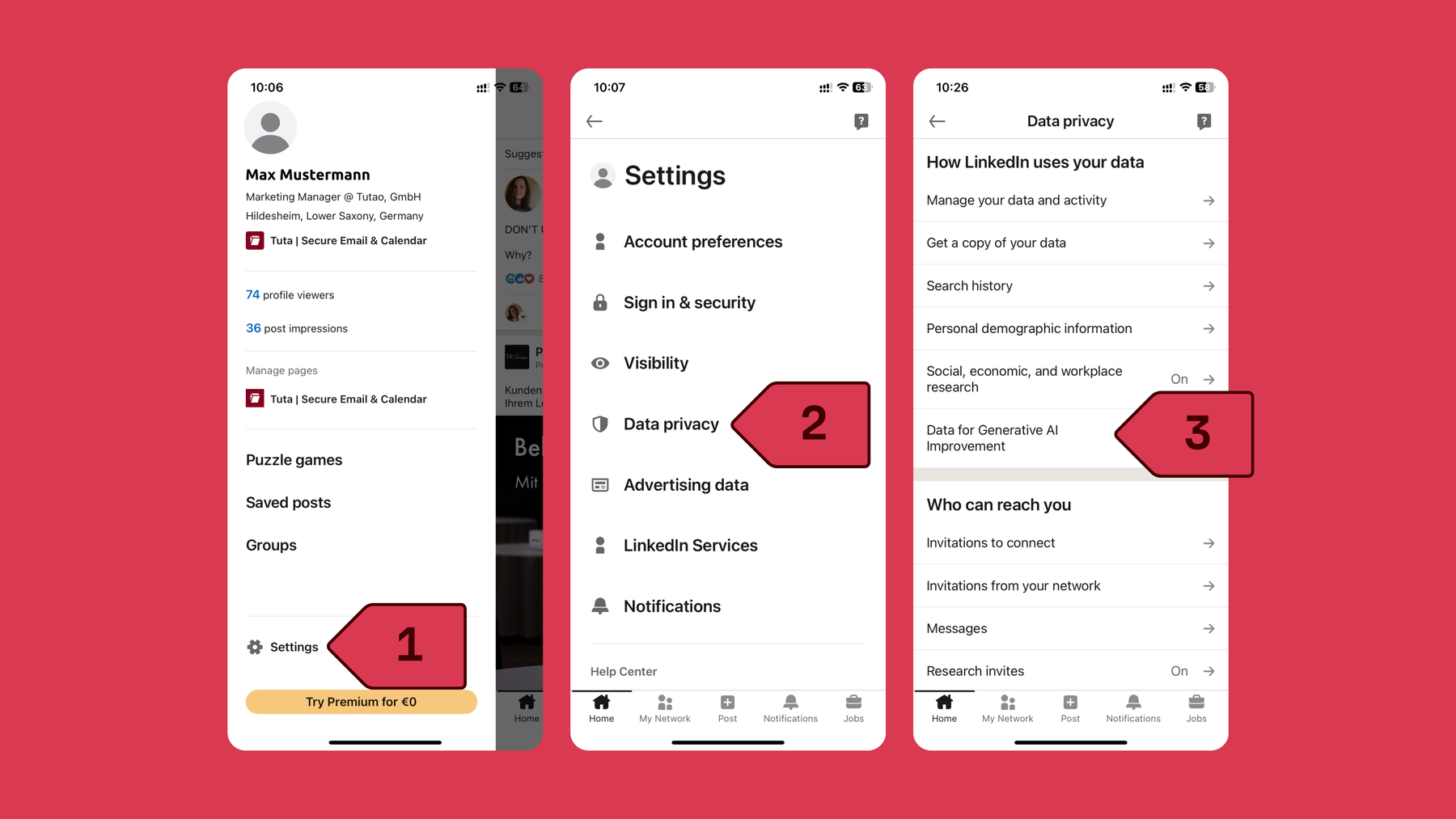

Suivez ces étapes pour refuser que LinkedIn utilise vos données pour entraîner l’IA sur l’application iPhone. Capture d’écran : LinkedIn.

- Ouvrez l’application LinkedIn sur votre téléphone et connectez-vous à votre compte.

- Cliquez sur votre photo de profil

- Cliquez pour ouvrir les Paramètres

- Sélectionnez Confidentialité des données

- Cliquez sur Données pour l’amélioration de l’IA générative

- À côté de Utiliser mes données pour former des modèles d’IA de création de contenu, cliquez pour désactiver la bascule.

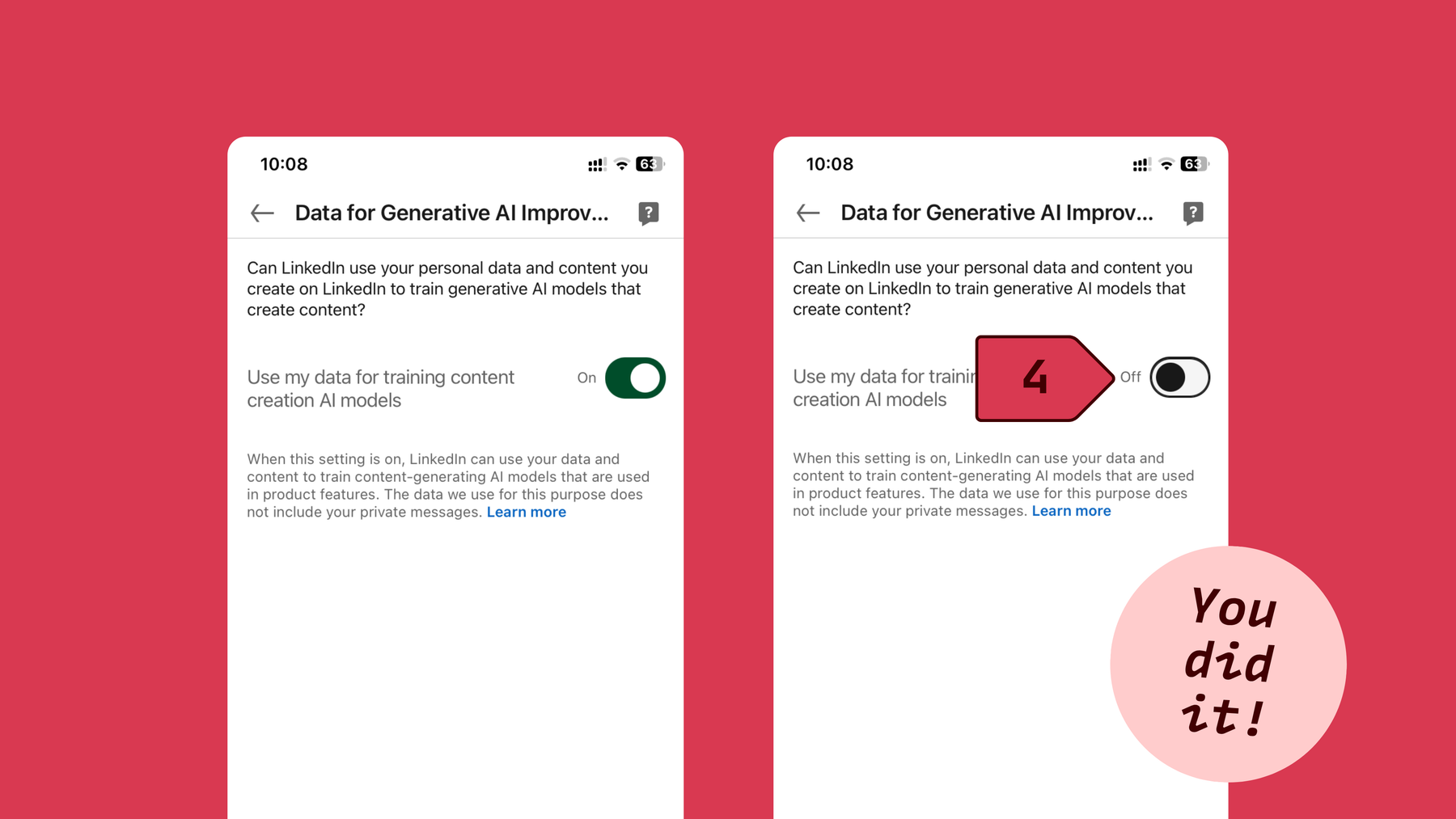

Désactiver l’IA de LinkedIn sur Android

- Ouvrez l’application LinkedIn sur votre Android et connectez-vous à votre compte.

- Cliquez sur votre photo de profil

- Cliquez pour ouvrir les paramètres

- Sélectionnez Données et confidentialité

- Cliquez sur Données pour l’amélioration de l’IA générative

- À côté de Utiliser mes données pour former des modèles d’IA de création de contenu, cliquez pour désactiver la bascule.

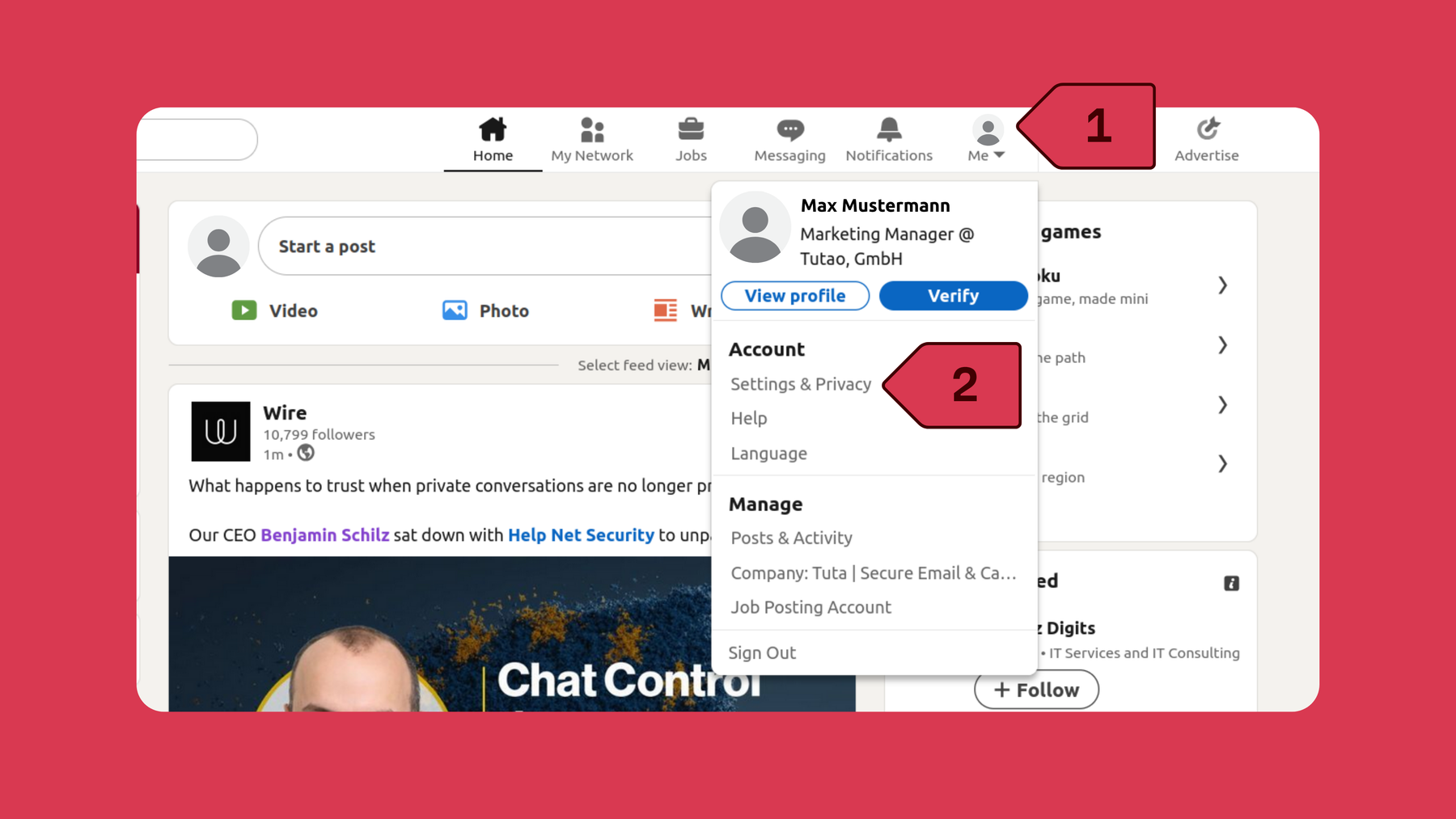

Empêcher LinkedIn d’utiliser vos données pour l’entraînement à l’IA à partir d’un navigateur

Suivez ces étapes pour refuser que LinkedIn utilise vos données pour former des modèles d’IA de création de contenu à partir d’un navigateur Web. Capture d’écran : LinkedIn.

- Connectez-vous à votre compte LinkedIn 2. Cliquez sur votre photo de profil 3. Cliquez sur Réglages et confidentialité 4. Sélectionnez Confidentialité des données 5. Cliquez sur Données pour l’amélioration de l’IA générative 6. À côté de Utiliser mes données pour former des modèles d’IA de création de contenu, cliquez pour désactiver la case.

En plus de refuser que vos données soient utilisées à l’avenir à des fins d’IA, vous pouvez également remplir ce formulaire d’opposition au traitement des données de LinkedIn pour rejeter ou demander une restriction du traitement de vos données personnelles.

Le choc passé face à l’introduction sournoise de l’opt-in de l’IA par LinkedIn

En 2024, LinkedIn a été confronté à des réactions négatives lorsque ses utilisateurs ont appris qu’ils avaient été autorisés par défaut à ce que leurs données soient utilisées pour entraîner des modèles d’IA. Plus inquiétant encore, le bouton de désactivation n’était pas un nouveau paramètre, mais il a choqué les utilisateurs de LinkedIn qui ne savaient pas que leurs données étaient déjà utilisées pour entraîner l’IA.

Le 18 septembre 2024, 404 Media a rapporté que LinkedIn n’avait même pas mis à jour sa politique de confidentialité avant de commencer à récupérer les données des utilisateurs. Lorsque 404 Media a contacté LinkedIn à ce sujet, l’entreprise lui a répondu qu’elle mettrait à jour ses conditions de service “sous peu”. La réponse de LinkedIn était, au mieux, extrêmement douteuse. Puis, le même jour, LinkedIn a discrètement publié un billet de blog rédigé par son avocat général, Blake Lawit, annonçant des modifications de sa politique de confidentialité et de ses conditions de service qui entreraient en vigueur le 20 novembre 2024. Les modifications apportées à l’accord d’utilisation et à la politique de confidentialité de LinkedIn expliquaient comment les données des utilisateurs seraient utilisées pour l’IA par l’entreprise.

On aurait pu s’attendre à ce que la plateforme appartenant à Microsoft annonce d’abord la modification de sa politique de confidentialité avant de racler les données des utilisateurs, mais dans ce cas, il semblait en être autrement.

Vie privée contre IA

Le fait que LinkedIn puisse désormais collecter les données des utilisateurs européens à des fins d’entraînement à l’IA est peut-être une nouvelle, mais il s’agit malheureusement d’une pratique courante et vos données sont probablement utilisées à des fins d’entraînement à l’IA par d’autres sites également. Même dans l’UE, qui protège les données de ses citoyens (dans une certaine mesure) avec le GDPR, les géants de la tech trouvent encore des échappatoires pour collecter les données des utilisateurs afin de développer leurs modèles d’IA.

Par exemple, le projet initial de Meta d’utiliser les données Facebook et Instagram des utilisateurs européens pour entraîner l’IA Meta a été mis en attente, mais depuis le 27 mai 2025, Meta utilise les données publiques Facebook et Instagram des utilisateurs européens pour l’entraînement à l’IA. Malheureusement pour les utilisateurs de Facebook dans d’autres parties du monde, comme les États-Unis, où il n’existe pas de lois sur la confidentialité des données comme le GDPR de l’UE, Facebook, qui appartient à Meta, a une portée beaucoup plus grande sur les données des utilisateurs et peut fondamentalement les utiliser comme il le souhaite. Par exemple, les données des utilisateurs sont utilisées pour l’entraînement à l’IA, et les gens n’ont aucun moyen de s’y opposer. Cela soulève non seulement d’énormes préoccupations en matière de confidentialité des données, mais souligne également le manque de choix et de liberté de l’utilisateur en ce qui concerne ses données et la manière dont elles sont utilisées.

Meta n’est pas le seul géant de la technologie à maltraiter les données des utilisateurs, bien sûr, Google et les auteurs de courriels AI le font aussi. Un utilisateur de Gmail a fait part d’une conversation qu’il a eue avec le chatbot Gemini AI de Google. Ce qui était choquant dans cette conversation, c’est que les données utilisées par le chatbot provenaient des courriels de l’utilisateur de Gmail. Même si l’utilisateur de Gmail n’avait jamais autorisé le modèle de langage à accéder à sa boîte aux lettres personnelle.

Ce que nous apprennent les deux exemples ci-dessus, c’est que ces fournisseurs de Big Tech ne pensent qu’à accroître leurs propres bénéfices, au lieu d’agir de manière éthique. Lorsqu’il s’agit de big tech, de profit et d’avancées techniques comme cette course folle pour monter dans le train de l’IA (souvent sans votre consentement), toutes les limites sont franchies.

Réflexions finales

Les changements apportés par LinkedIn à la manière dont il traite les informations des utilisateurs peuvent surprendre certaines personnes qui utilisent la plateforme, mais malheureusement, cela ne sort pas de l’ordinaire lorsqu’il s’agit de la manière dont de nombreuses entreprises technologiques traitent les données. LinkedIn est une autre entreprise technologique qui a rejoint la tendance de l’IA et utilise les informations des utilisateurs pour entraîner ses modèles.

Si vous consultez régulièrement le blog de Tuta, vous savez que les grandes entreprises technologiques fonctionnent selon le modèle commercial qui consiste à tirer profit de vos informations personnelles. Leur approche insouciante de la vie privée suit une méthode éprouvée qui consiste à collecter autant de données que possible, à les vendre aux annonceurs qui, en retour, vous ciblent avec des publicités. Rincer, laver, répéter. Un exemple parfait est la façon dont Meta et Google offrent leurs nombreux produits gratuitement - mais le prix est payé avec vos données, pas avec de l’argent. Et aujourd’hui, avec la course de toutes les entreprises à l’utilisation de l’IA, vos données ne sont pas seulement utilisées pour tirer profit de la publicité, mais elles semblent encore plus précieuses pour ces entreprises.

Cet engouement pour le développement de l’IA et l’utilisation de vos données est une tendance qui n’est pas près de disparaître. Ce que nous pouvons retenir, c’est que les entreprises en ligne les plus populaires, comme Meta, Google et Microsoft, pour n’en citer que quelques-unes, feront toujours passer les profits en premier et l’éthique en second.

Ceci étant dit, si vous choisissez de continuer à utiliser ces plateformes, il est conseillé de rester informé et à jour de tout changement apporté à leurs conditions d’utilisation et à leurs politiques de confidentialité, ce qui est une tâche difficile pour ceux d’entre nous qui ne parlent pas le jargon juridique, mais c’est nécessaire. Surtout si vous vous préoccupez de vos données et de votre vie privée.

Et si vous êtes vraiment inquiet pour votre vie privée, nous vous recommandons d’abandonner définitivement les services tels que Gmail ou Facebook.

L’inquiétude croissante quant à la manière dont les entreprises traitent les données et la vie privée des utilisateurs a entraîné une augmentation du développement d’alternatives étonnantes axées sur la protection de la vie privée. Et les gens vont de plus en plus loin en choisissant de se désengager de Google et d’arrêter complètement d’utiliser les grands services technologiques.

Heureusement, en 2026, c’est possible ! Par exemple, en remplaçant Gmail par Tuta Mail, ou en remplaçant WhatsApp de Meta par de meilleures plateformes de messagerie comme Signal.

Choisissez Tuta pour l’absence d’IA et de publicité

Vous voulez vous assurer que vos courriels ne sont PAS utilisés pour entraîner l’IA ? Passez simplement à Tuta Mail - en tant que fournisseur d’emails et de calendriers cryptés de bout en bout, nous ne rejoindrons pas le train de l’IA !

Basé en Allemagne et fonctionnant selon des lois strictes sur la confidentialité des données, Tuta est open source, conforme au GDPR et entièrement chiffré de bout en bout.

Contrairement aux fournisseurs de messagerie populaires, Tuta Mail crypte autant de données utilisateur que possible, maintenant avec le premier protocole de cryptage post-quantique au monde ! Sans lien avec Google, Tuta Mail n’a pas de publicité, ne suit pas ses utilisateurs et est conçu avec la vie privée à l’esprit.

Reprenez votre vie privée et assurez-vous que vos courriels ne sont pas utilisés pour l’entraînement de l’IA.