Gmail、微软、Meta、LinkedIn:它们已经在自愿扫描你的信息!

自 2021 年起,自愿聊天控制(Voluntary Chat Control)已开始实施,并被命名为法规(EU)2021/1232。与英国和美国的扫描义务类似,该法规允许大科技公司扫描您的所有数据。但是,根据这项法规,服务会扫描哪些内容,是否也会扫描旧信息,这对数据保护和隐私意味着什么?深入探讨。

如果你认为这对你来说无关紧要,因为你没有什么可隐瞒的,那么请看看这位爸爸的故事,他的整个 Google 账户是如何被删除的,因为他向家庭医生发送了一张儿子的裸照。

现在,我引起你的注意了,看看谁在扫描你的电子邮件和信息,以及你能做些什么!

自愿聊天控制: 条例(欧盟)2021/1232

三年多来,欧盟一直在讨论检测儿童性虐待材料(CSAM)的法规,因其巨大的监控影响而被命名为 “聊天控制”。虽然隐私权倡导者成功地在当前的 “聊天控制 “提案中取消了破解端到端加密的义务,但欧盟已经实施了一种自愿形式的 “聊天控制”,而美国的大型科技服务也在大量使用这种 “聊天控制”:2021/1232 号法规。

Gmail、Facebook、Instagram、WhatsApp、微软、LinkedIn、苹果—它们都根据这一法规扫描你的数据,通常使用微软开发的一种名为photoDNA 的工具。大科技公司只扫描新收到的信息和电子邮件,不会扫描旧信息—这些信息在过去已经被扫描过了。

欧盟委员会要求大科技公司提供有关扫描的数据,以证明扫描是适度的。但欧盟委员会无法证明其观点:

关于条例(EU)2021/1232 的相称性,问题在于该条例是否实现了所寻求的平衡:一方面,实现了有效打击极度严重犯罪的普遍利益目标,另一方面,需要保护儿童的基本权利(如尊严、人格完整、禁止对儿童使用暴力等)。例如,尊严、人格完整、禁止不人道或有辱人格的待遇、私生活、儿童权利等),另一方面,保障所涵盖服务用户的基本权利(例如,隐私、个人数据保护、言论自由、有效补救等)。现有数据不足以对这一问题给出明确答案 “。

欧盟委员会没有证明该规定是相称的—因为大规模扫描个人数据是对每个公民私人生活的严重侵犯,绝不允许 “以防万一”—而是简单地表示,扫描信息并非不相称,因此是可以的 :

鉴于性虐待对儿童的生活和权利造成了极大的负面影响,因此在评估相称性时,不可能也不 宜采用数字标准来衡量获救儿童的数量。尽管如此,鉴于上述情况,没有迹象表明减损是不相称的 “。

这种举证责任倒置的做法受到了Netzpolitik以及前欧盟议员兼律师Patrick Breyer 的严厉批评,他称欧盟委员会的结论是 “法律上的无稽之谈”。

但让我们自己来看看数据!

大科技扫描数十亿数据集

只有两家服务提供商向欧盟委员会报告了自愿 CSAM 扫描规模的具体数据:微软和 LinkedIn。

-

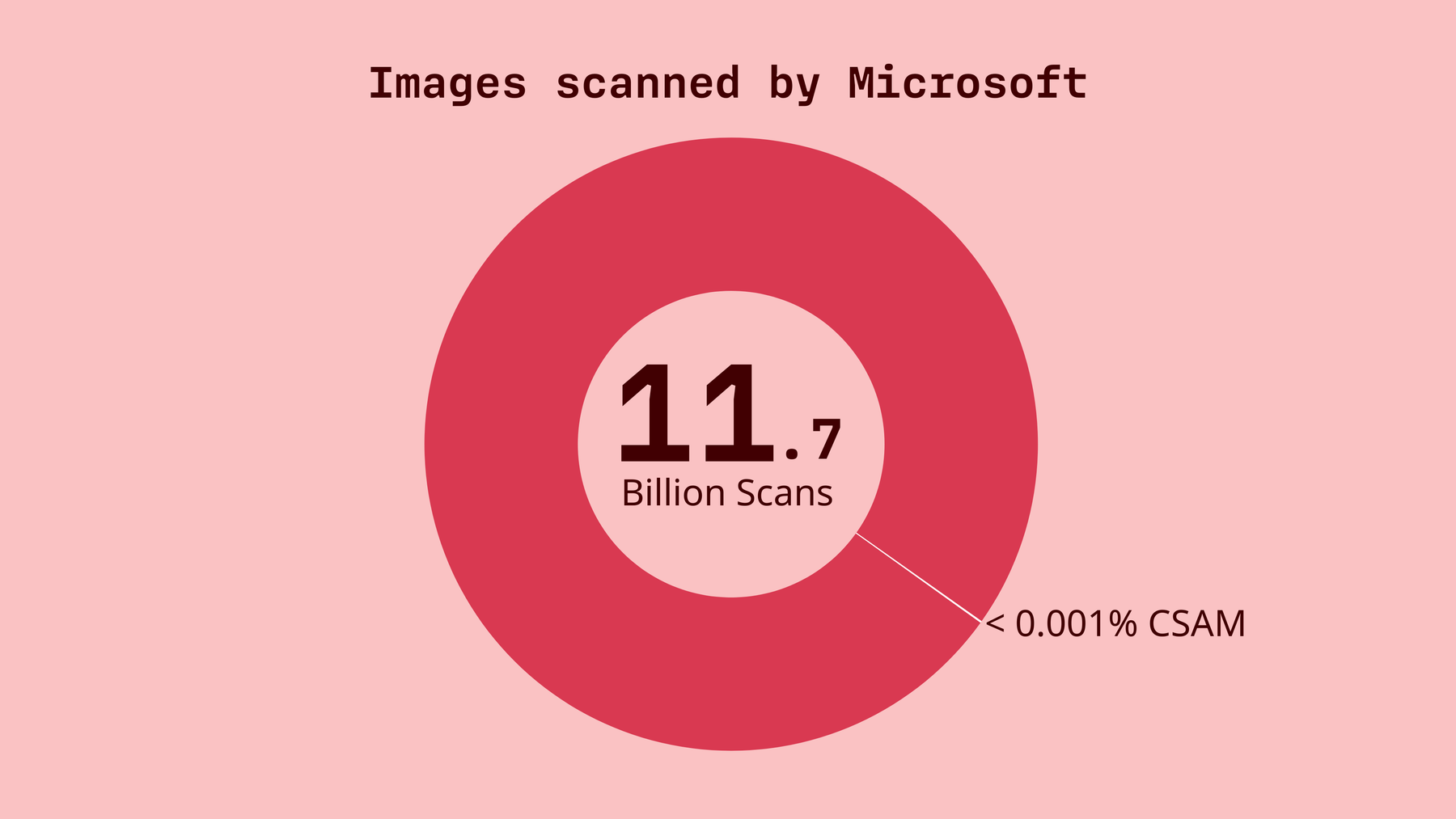

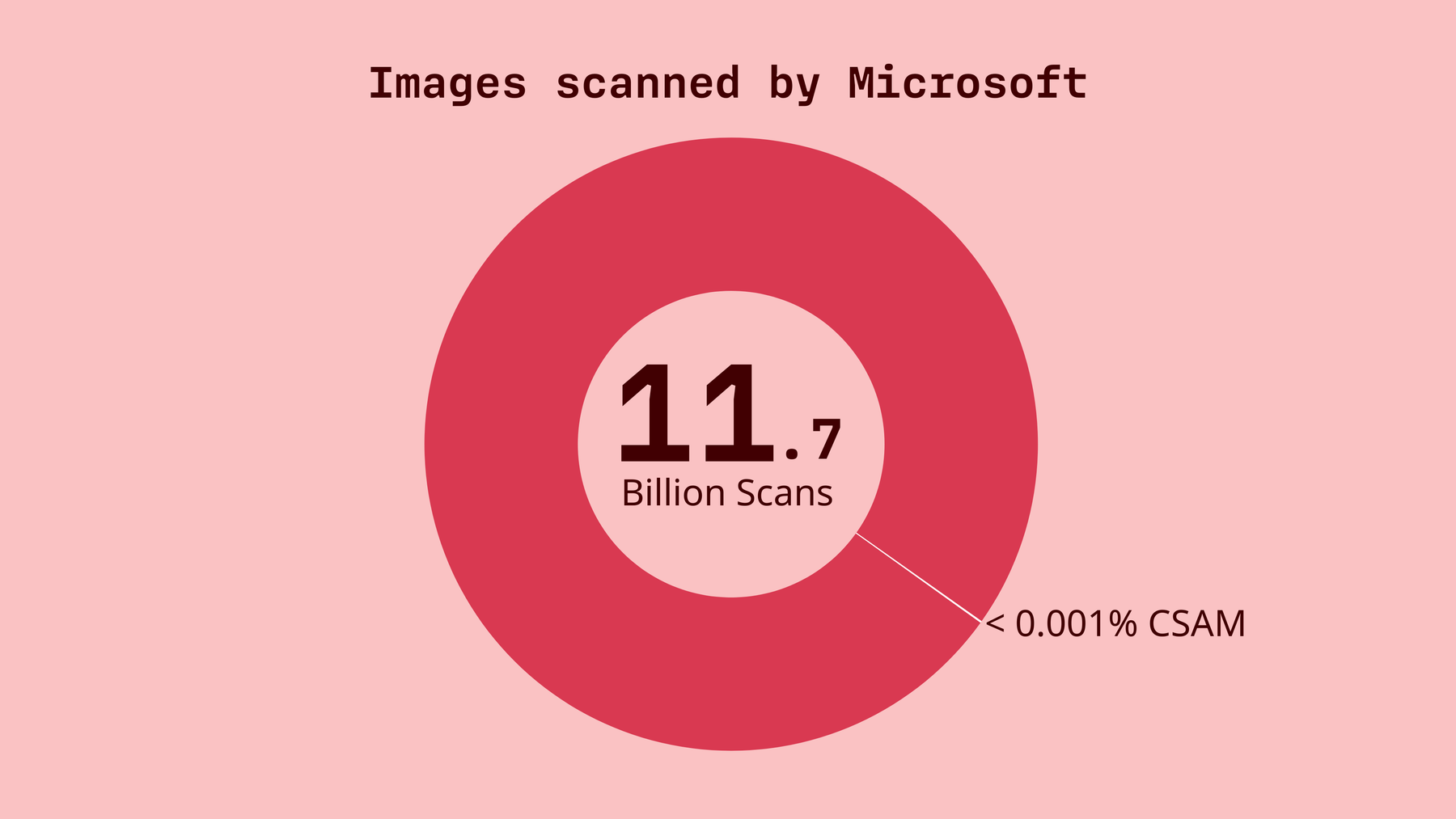

微软 在 2023 年扫描了全球超过 117 亿张图片和视频,在 2024 年扫描了略低于 100 亿张图片和视频。他们没有提供欧盟的数据。

-

2023 年,微软将 32,000 个数据集标记为潜在的儿童性虐待材料,其中包括欧盟的 9,000 多个数据集。这相当于 0.0002735 %,即每 365,000 次扫描有 1 次命中。

-

2024 年,微软将 26,000 个数据集标记为潜在的儿童性虐待材料,其中包括欧盟的 5,800 多个数据集。这相当于 0.00027083 %,或每 36.9 万次扫描中出现 1 次。

-

LinkedIn 的 扫描量 要小得多,但所有扫描都涉及欧洲内容。

-

在 2023 年,共扫描了 2400 多万张图片和 100 多万部视频,结果有 2 张图片被标记为潜在的儿童性虐待材料,没有视频被标记为潜在的儿童性虐待材料。这相当于 0.00000833 %,即每 1200 万次扫描有 1 次命中。

-

2024 年,扫描了 2200 多万张图片和 200 多万部视频,结果有 1 张图片和 1 部视频被标记为潜在的儿童性虐待材料。这一比例为 0.00000417%,即每 2400 万次扫描有 1 次命中。

在这两种情况下,大规模扫描只产生了极小的结果,然而,欧盟委员会称自愿聊天控制措施是适度的。

谷歌没有透露扫描了多少内容,只透露了结果,但基于谷歌是最大的在线服务之一这一事实,数字很可能达到数百万。在 2023 年和 2024 年,谷歌分别标记了 1558 个和 1824 个数据集。鉴于谷歌的规模,其扫描量可能与微软相当,这意味着扫描结果也仍远低于每百万分之一的范围。

与 Facebook、Instagram 和 WhatsApp 等服务相比,Meta 的数据要高得多。2023 年和 2024 年,硅谷科技巨头分别将 360 万和 150 万张图片和视频标记为欧盟潜在的 CSAM。

在用户报告中也可以看到类似的模式:在谷歌,分别有 297 名(2023 年)和 216 名(2024 年)用户报告了非法材料。在 Meta,254,500(2023 年)和 76,900 (2024 年)名用户报告了非法材料。在委员会的报告中,没有解释为什么这些数字相差如此之大。

从批判的角度来看,这些数字根本无法证明对每个人的信息进行大规模扫描是适度的。而即将在 “三方对话 “中讨论的 “聊天控制 “草案可能会允许更广泛的扫描—仍然是自愿的,但会对您的隐私造成重大影响。

好与坏

当前聊天控制提案的好处是,对电子邮件和聊天信息的扫描仍将是自愿的。该提案不会强迫Tuta Mail 这样的端到端加密电子邮件提供商 开启加密后门。因此,在 Tuta,您的数据仍将是安全的。我们 Tuta 为您的隐私权而战;在 2024 年 “聊天控制 “争论最激烈的时候,我们甚至威胁要起诉欧盟忽视每个人的隐私权,但现在已经没有必要了。

然而,自愿性聊天控制的核心不仅从根本上不好,而且是错误的:在没有证明该措施与保护儿童相称的情况下,欧盟委员会牺牲了每个人的个人生活,让大科技公司对每个人的隐私进行了巨大的侵犯—而大科技公司不需要被问第二遍。

因此,Gmail、微软、LinkedIn、Meta—它们都会愉快地扫描你的数据,而不会有任何问题。 这使得他们不仅可以扫描你的数据以获取 CSAM,还可以扫描你的数据以获取他们想要的任何其他信息;正如谷歌首席执行官曾经说过的那样,他们可以对你了如指掌,还可以创建你的个人档案以发布有针对性的广告。

转向隐私保护

然而,你还有一个选择:有一些服务可以提供免费、安全的电子邮件、聊天和社交媒体解决方案,而且不会对你进行任何跟踪或特征分析。

此外,这里还有你需要去谷歌的所有应用程序,这样你就再也不需要为谷歌的垄断行为买单了。

向大科技及其数据收集说 “不”。向隐私说 “嗨”!