Gmail, Microsoft, Meta, LinkedIn: Ya escanean tus mensajes, ¡voluntariamente!

El Control Voluntario del Chat ya está en vigor desde 2021, con el nombre de Reglamento (UE) 2021/1232. Similar a las obligaciones de escaneo en el Reino Unido y Estados Unidos, este reglamento permite a las grandes tecnológicas escanear todos tus datos. Pero, ¿qué escanean los servicios en base a este reglamento, escanean también los mensajes antiguos y qué significa esto para la protección de datos y la privacidad? Una inmersión en profundidad.

Y si crees que esto no te importa porque no tienes nada que ocultar, echa un vistazo a la historia de este padre a quien le borraron toda su cuenta de Google porque envió una foto de su hijo desnudo al médico de cabecera.

Ahora que te he llamado la atención, comprueba quién escanea tus correos electrónicos y mensajes y qué puedes hacer al respecto.

Control voluntario del chat: Reglamento (UE) 2021/1232

Durante más de tres años, la Unión Europea ha estado debatiendo el reglamento para detectar Material de Abuso Sexual Infantil (CSAM), denominado Chat Control por sus inmensas implicaciones de vigilancia. Y aunque los defensores de la privacidad han conseguido eliminar la obligación de romper el cifrado de extremo a extremo en la actual propuesta de Chat Control, la UE ya ha puesto en marcha una forma voluntaria de Chat Control muy utilizada por los servicios de las grandes tecnológicas estadounidenses: el reglamento 2021/1232.

Gmail, Facebook, Instagram, WhatsApp, Microsoft, LinkedIn, Apple… todos ellos escanean tus datos basándose en este reglamento, a menudo con una herramienta desarrollada por Microsoft, llamada photoDNA. Las grandes tecnológicas solo escanean los mensajes y correos electrónicos recién llegados, no los antiguos, que ya han sido escaneados en el pasado.

La Comisión Europea ha pedido a Big Tech datos sobre los escaneos para demostrar que son proporcionados. Pero la Comisión de la UE no ha podido demostrarlo:

En cuanto a la proporcionalidad del Reglamento (UE) 2021/1232, la cuestión es si el Reglamento logra el equilibrio buscado entre, por una parte, la consecución del objetivo de interés general de luchar eficazmente contra los delitos extremadamente graves en cuestión y la necesidad de proteger los derechos fundamentales de los niños (e.p. ej. dignidad, integridad, prohibición de tratos inhumanos o degradantes, vida privada, derechos del niño, etc.) y, por otra parte, la salvaguardia de los derechos fundamentales de los usuarios de los servicios cubiertos (p. ej. intimidad, protección de datos personales, libertad de expresión, tutela judicial efectiva, etc.). Los datos disponibles son insuficientes para dar una respuesta definitiva a esta pregunta”.

En lugar de demostrar que la normativa es proporcionada -porque el escaneo masivo de datos personales es una grave intrusión en la vida privada de todos los ciudadanos y no debe permitirse “por si acaso”-, la Comisión Europea se limita a afirmar que el escaneo de mensajes no es desproporcionado y, por tanto, está bien:

No es posible ni sería adecuado aplicar un criterio numérico a la hora de evaluar la proporcionalidad en términos del número de niños rescatados, dado el importante impacto negativo que los abusos sexuales tienen en la vida y los derechos de los niños. No obstante, a la luz de lo anterior, no hay indicios de que la excepción no sea proporcionada” .

Esta inversión de la carga de la prueba ha sido duramente criticada por Netzpolitik, así como por Patrick Breyer, antiguo parlamentario y abogado de la UE, que califica la conclusión de la Comisión Europea de “disparate jurídico”.

¡Pero veamos los datos nosotros mismos!

Big Tech escanea miles de millones de conjuntos de datos

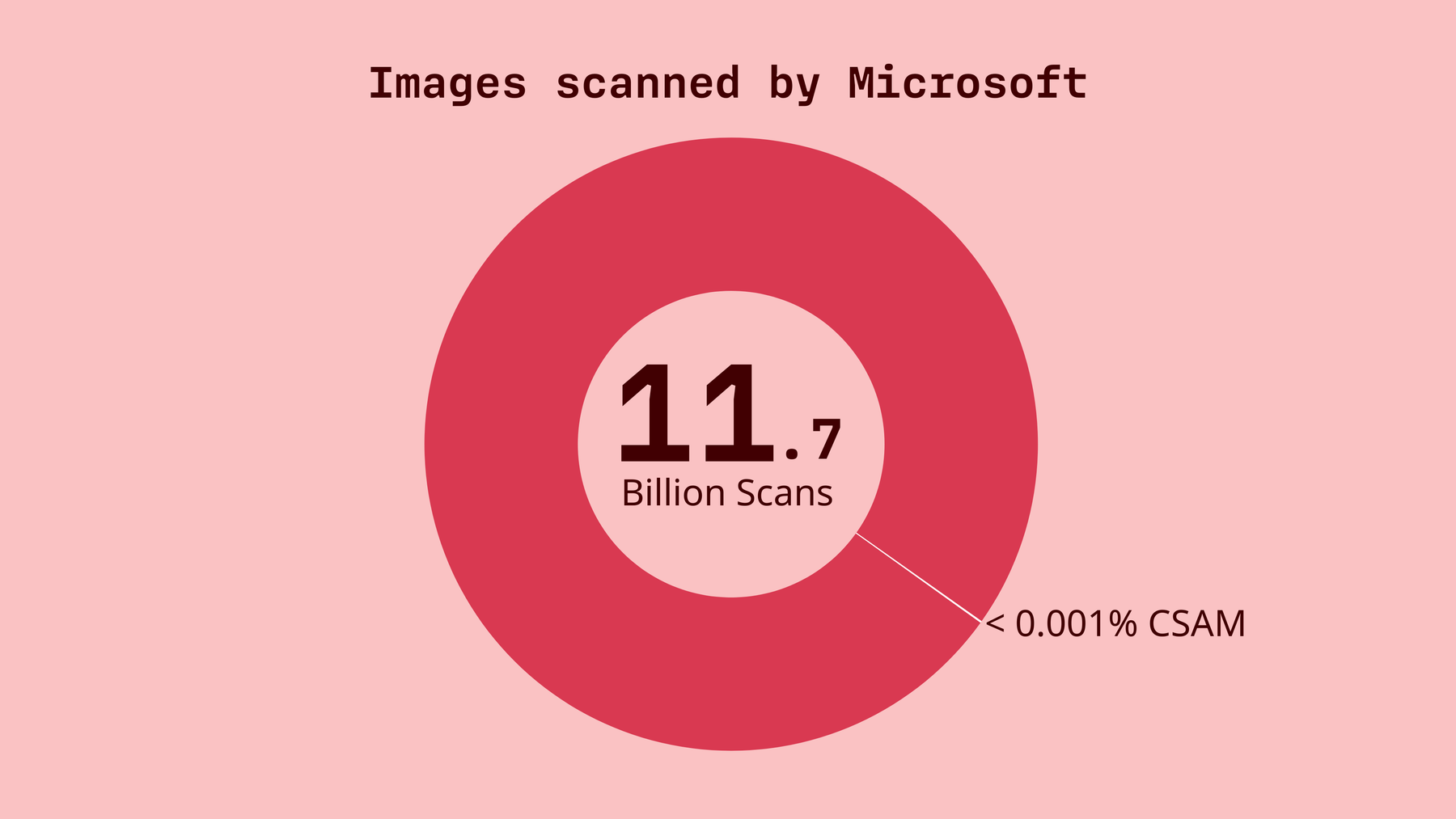

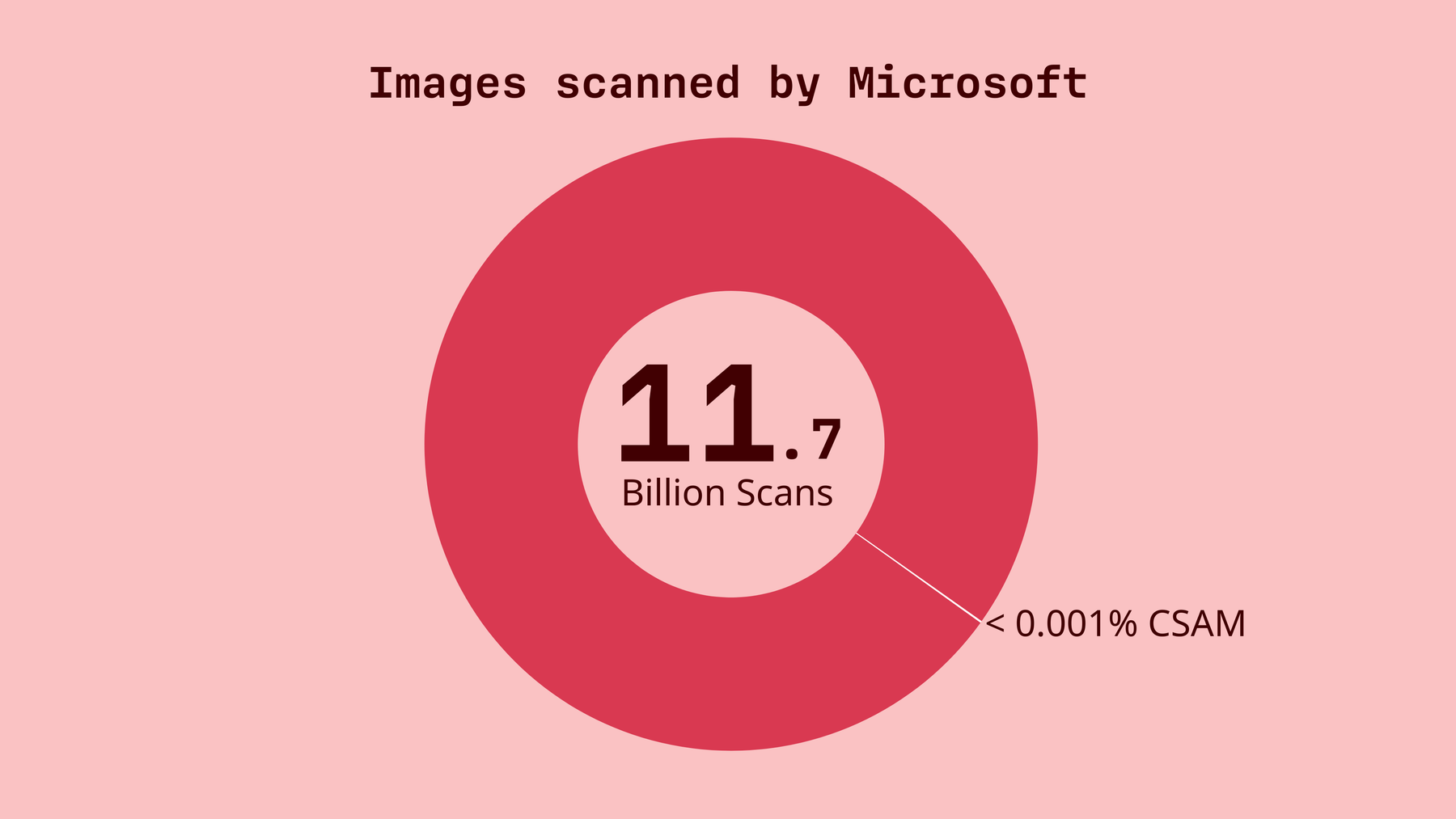

Solo dos proveedores de servicios comunicaron cifras concretas a la Comisión Europea sobre la magnitud del escaneado voluntario de CSAM: Microsoft y LinkedIn.

-

Microsoft escaneó más de 11 700 millones de imágenes y vídeos en todo el mundo en 2023 y algo menos de 10 000 millones en 2024. No facilitaron cifras solo para la UE.

-

En 2023, Microsoft marcó 32.000 conjuntos de datos como posible material de abuso sexual infantil, incluidos más de 9.000 conjuntos de datos en la UE. Esto supone un 0,0002735 %, o 1 resultado positivo por cada 365.000 escaneos.

-

En 2024, Microsoft marcó 26.000 conjuntos de datos como posible material de abuso sexual infantil, incluidos más de 5.800 conjuntos de datos en la UE. Esto supone un 0,00027083 %, o 1 acierto por cada 369.000 escaneos.

-

Los volúmenes de LinkedInfueron mucho menores, pero todas las exploraciones se referían a contenidos europeos.

-

En 2023, se escanearon más de 24 millones de imágenes y más de 1 millón de vídeos, con el resultado de 2 imágenes marcadas y ningún vídeo marcado como material potencial de abuso sexual infantil. Esto supone un 0,00000833 %, o 1 acierto por cada 12 millones de escaneos.

-

En 2024, se escanearon más de 22 millones de imágenes y más de 2 millones de vídeos, con el resultado de 1 imagen y ningún vídeo marcados como material potencial de abuso sexual infantil. Esto se reduce al 0,00000417 %, o 1 acierto por cada 24 millones de escaneados.

En ambos casos, el escaneado masivo sólo produjo resultados mínimos, pese a lo cual la Comisión de la UE califica de proporcionada la medida de control de chat voluntario.

Google no reveló cuántos contenidos se escanearon, sólo los resultados, pero teniendo en cuenta que Google es uno de los mayores servicios en línea, lo más probable es que las cifras se cuenten por millones. En 2023 y 2024, Google marcó 1.558 y 1.824 conjuntos de datos respectivamente. Dado el tamaño de Google, es probable que los volúmenes de escaneado sean comparables a los de Microsoft, lo que significa que los resultados también se mantienen muy por debajo del rango por millón.

Meta con servicios como Facebook, Instagram y WhatsApp destaca claramente con cifras mucho más elevadas. En 2023 y 2024, el gigante tecnológico de Silicon Valley señaló 3,6 millones y 1,5 millones de imágenes y vídeos como posibles CSAM en la UE.

Al examinar los informes de los usuarios se observa un patrón similar: En Google, 297 (2023) y 216 (2024) usuarios denunciaron material ilegal. En Meta, 254.500 (2023) y 76.900 (2024) usuarios denunciaron material ilegal. En el informe de la Comisión no se explica por qué estas cifras difieren tanto.

Estas cifras, si se analizan críticamente, no demuestran en absoluto que el escaneo masivo de los mensajes de todo el mundo sea proporcionado. Y el próximo proyecto de Control del Chat, que pronto se debatirá en el Trílogo, podría permitir un escaneo aún más amplio, aún de forma voluntaria, pero con importantes consecuencias para tu privacidad.

Lo bueno y lo malo

Lo bueno de la actual propuesta de Control del Chat es que el escaneado de correos electrónicos y mensajes de chat seguirá siendo voluntario. La propuesta no obligará a los proveedores de correo electrónico cifrado de extremo a extremo, como Tuta Mail, a ocultar el cifrado. Así que en Tuta, sus datos seguirán estando seguros. En Tuta estamos aquí para luchar por tu derecho a la privacidad; cuando el debate sobre el Chat Control estaba en su punto álgido en 2024, incluso amenazamos con demandar a la UE por desatender el derecho de todos a la privacidad, algo que ahora ya no es necesario.

Sin embargo, el control voluntario del chat en el fondo no sólo es fundamentalmente malo, sino que es erróneo: Sin demostrar que la medida es proporcionada para proteger a los niños, la Comisión de la UE sacrifica la vida personal de todos al abrir una inmensa intrusión en la privacidad de todos por parte de las grandes tecnológicas, y a las grandes tecnológicas no hace falta preguntarles dos veces.

Así, Gmail, Microsoft, LinkedIn, Meta… todos ellos escanean tus datos alegremente, sin tener ningún problema con ello. Esto les permite no sólo escanear tus datos en busca de CSAM, sino potencialmente de cualquier otra cosa que deseen; conocerte al dedillo , como dijo una vez un famoso CEO de Google, y crear un perfil sobre ti para publicar anuncios dirigidos.

Cambiar a la privacidad

Sin embargo, tienes otra opción: hay servicios que ofrecen soluciones gratuitas y seguras de correo electrónico, chat y redes sociales, sin ningún tipo de seguimiento ni elaboración de perfiles.

Aquí tienes algunas alternativas europeas a las grandes tecnológicas que apuestan por la privacidad.

Di “no” a las grandes empresas tecnológicas y a su recopilación de datos. Di “Hola” a la privacidad.