O Microsoft Copilot tinha acesso aos e-mails confidenciais das organizações - sem permissão.

A Microsoft reconheceu que uma falha no Microsoft 365 Copilot concedeu inadvertidamente ao assistente de IA acesso a mensagens de correio eletrónico confidenciais.

De acordo com o Bleeping Computer, um relatório de serviço sobre o bug(rastreado como CW1226324), que foi inicialmente detectado em 21 de janeiro, afeta o recurso de bate-papo da “guia de trabalho” do Copilot. Isso permite que ele leia e resuma e-mails nas pastas enviadas e de rascunho dos usuários. Mais preocupante, a IA teve acesso para ler e resumir e-mails marcados com rótulos de confidencialidade, que são explicitamente projetados para garantir que ferramentas automatizadas não tenham acesso.

A Microsoft disse quando confirmou o problema ao Bleeping Computer:

O bate-papo da ‘guia de trabalho’ do Microsoft 365 Copilot está resumindo as mensagens de e-mail, embora essas mensagens de e-mail tenham um rótulo de sensibilidade aplicado e uma política DLP esteja configurada.

O gigante da tecnologia do Vale do Silício também disse que um “problema de código está permitindo que itens nos itens enviados e pastas de rascunho sejam coletados pelo Copilot, embora rótulos confidenciais estejam definidos no lugar.” A Microsoft agora confirmou que começou a lançar uma correção para o bug no início de fevereiro. Na quarta-feira, a Microsoft afirmou que estava a monitorizar a implementação e que estava a contactar alguns utilizadores para confirmar que a correção estava a funcionar.

Não vale a pena correr o risco de usar o Copilot para aumentar a produtividade

A Microsoft tem impulsionado o lançamento de sua IA, Copilot, em todos os aplicativos do Microsoft 365 - não apenas para uso pessoal, mas também para que as empresas se integrem à força de trabalho. Em setembro de 2025, o Copilot Chat, o chat alimentado por IA da Microsoft que permite aos utilizadores interagir com agentes de IA, foi implementado no Excel, Word, Outlook, PowerPoint e OneNote para clientes empresariais do Microsoft 365. Agora, apenas quatro meses depois, um bug comprometeu os dados sensíveis dos utilizadores do Microsoft 365.

Embora a utilização de assistentes de IA, como o Copilot Chat, esteja a ser globalmente apresentada pelos gigantes da tecnologia para aumentar a produtividade e acelerar os fluxos de trabalho, o que é claro é que as tecnologias de IA novas e em desenvolvimento podem tornar-se um risco extremo para a segurança e a privacidade - especialmente para as organizações que precisam de proteger informações sensíveis.

Aumentos de preços, IA e um erro grave: Adeus confidencialidade do correio eletrónico!

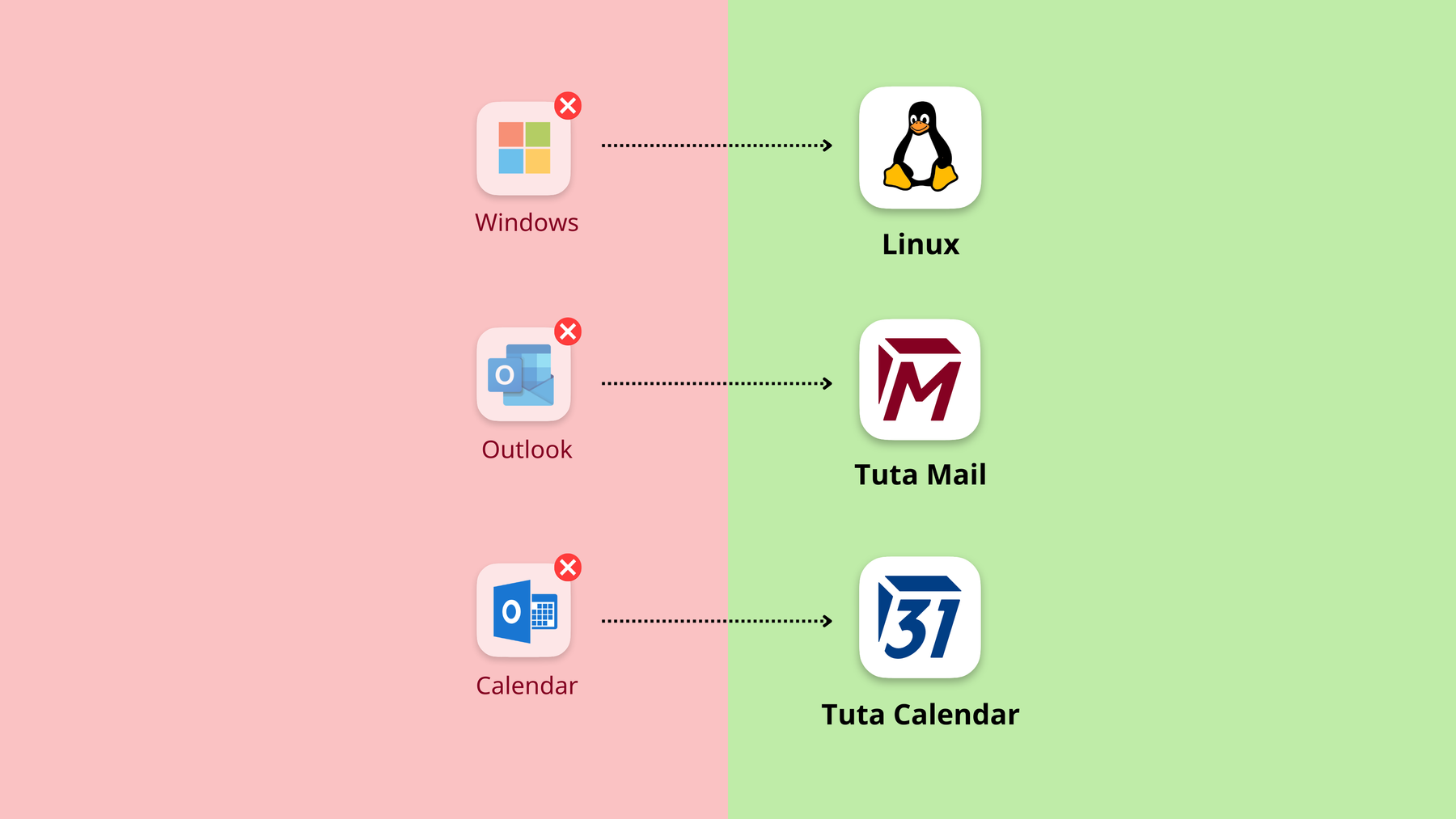

Atualmente, muitas empresas utilizam o Microsoft Outlook, sobretudo porque está incluído nas ferramentas do Office da Microsoft, como o Word e o Excel, mas os desenvolvimentos recentes mostram que a mudança para alternativas, especialmente para o correio eletrónico, se torna cada vez mais atractiva.

-

Em janeiro de 2026, um bug permitiu que o Copilot Chat resumisse emails apesar de ter etiquetas de sensibilidade e políticas DLP configuradas.

-

Em 2025, a Microsoft anunciou grandes aumentos de preços do Microsoft 365 com início em julho de 2026.

-

Em setembro de 2025, a Microsoft implementou o Copilot Chat no Excel, Word, Outlook, PowerPoint e OneNote para clientes empresariais pagantes do Microsoft 365.

Uma coisa que fica clara com tudo isso: Se a sua empresa utiliza o Microsoft 365, está na altura de abandonar a dependência do fornecedor e proteger as suas informações confidenciais. Felizmente, existem excelentes alternativas aos produtos Microsoft disponíveis.

Está na altura de abandonar o bloqueio do fornecedor

Este não é o primeiro nem o último problema de segurança com que a Microsoft se depara.

-

Em 2024, o governo dos EUA pediu à Microsoft que corrigisse a sua segurança, antes de adicionar novas funcionalidades, depois de a China ter pirateado os servidores de correio eletrónico da Microsoft.

-

Em 2025, as empresas foram avisadas para não mudarem para o “Novo Outlook” por este não respeitar as leis de proteção de dados que as empresas têm de cumprir.

-

Em 2025, a Microsoft desencadeou a tendência da soberania digital europeia, depois de o advogado da Microsoft em França ter confirmado que todos os dados alojados na Microsoft, mesmo que armazenados em centros de dados europeus, podem ser acedidos pelo governo dos EUA - sem aviso prévio.

Com a integração e o rápido desenvolvimento do Copilot no Microsoft 365, os dados dos indivíduos e das organizações continuarão em risco.

O anúncio deste bug, apenas alguns meses após o lançamento do Copilot nos planos de negócios do Microsoft 365, destaca por que os assistentes de IA não pertencem ao e-mail e a importância de usar e-mail criptografado de ponta a ponta, como o Tuta Mail.