Escaneo del CSAM: Las mentiras de la Comisión Europea al descubierto - La vigilancia no salvará a los niños.

Hemos analizado las órdenes de vigilancia de las telecomunicaciones. Los datos muestran que el escaneo CSAM de la UE es completamente desproporcionado y debe ser detenido.

En su proyecto de ley para luchar contra los abusos sexuales a menores, la Comisión Europea describe uno de los aparatos de vigilancia masiva más sofisticados jamás desplegados fuera de China: El escaneo CSAM en los dispositivos de todo el mundo. Como servicio de correo electrónico, recibimos regularmente órdenes de vigilancia de las autoridades alemanas. Hemos analizado estos datos para averiguar si las órdenes de vigilancia se emiten para perseguir a los pederastas.

Escaneo CSAM

El proyecto de reglamento de la Comisión Europea sobre la prevención y la lucha contra el abuso infantil es un ataque frontal a los derechos civiles. Y la Comisión de la UE está presionando para que este proyecto se convierta en ley con enormes exageraciones.

Como ciudadanos podemos esperar más de la Comisión de la UE. Lo menos que podemos pedir cuando la Comisión quiere introducir mecanismos de vigilancia que debilitarán inmensamente la ciberseguridad de Europa sería una comunicación honesta.

Nadie niega que los abusos sexuales a menores son un gran problema que hay que abordar. Pero cuando se proponen medidas tan drásticas como el escaneo por parte del CSAM de cada mensaje de chat privado, los argumentos deben ser sólidos. De lo contrario, la Comisión Europea no ayuda a nadie: ni a los niños, ni a nuestras sociedades libres y democráticas.

La Comisión Europea ha conseguido introducir tres argumentos en el debate público para inclinar la opinión pública a favor del escaneo de material CSA en todos los dispositivos. Pero los argumentos son descaradamente erróneos:

- Uno de cada cinco: La Comisión de la UE afirma que uno de cada cinco niños de la UE sufriría abusos sexuales.

- La vigilancia basada en la IA no perjudicaría nuestro derecho a la privacidad, sino que salvaría a los niños.

- El 90 % del CSAM se alojaría en servidores europeos

La Comisión de la UE utiliza la afirmación de “Uno de cada cinco” para justificar la propuesta de vigilancia generalizada de todos los ciudadanos europeos.

Sí, el abuso infantil es un problema inmenso. Todos los expertos en el campo de la protección de la infancia estarán de acuerdo en que la política debe hacer más para proteger a los más vulnerables de nuestra sociedad: los niños.

Sin embargo, la cuestión de la proporción debe ser analizada muy de cerca cuando se trata del escaneo del CSAM en nuestros dispositivos personales: ¿Está bien que la UE introduzca mecanismos de vigilancia masiva para todos los ciudadanos de la UE en un intento de atajar los abusos sexuales a menores?

La asociación alemana “Digitale Gesellschaft” ha publicado un vídeo que pretende responder también a la cuestión de la proporcionalidad; ¡merece la pena verlo!

Para encontrar una respuesta a la cuestión de la proporcionalidad, tenemos que dejar de lado la propaganda de la Comisión Europea y, en su lugar, plantear varias preguntas:

1. Uno de cada cinco

¿De dónde sale la cifra “Uno de cada cinco”?

No hay ninguna estadística que respalde la afirmación “Uno de cada cinco”. Esta cifra aparece de forma destacada en un sitio web del Consejo de Europa, pero sin dar ninguna fuente.

Según la Organización Mundial de la Salud (OMS ), el 9,6% de los niños de todo el mundo sufren abusos sexuales. Al contrario que las cifras de la UE, estos datos se basan en un estudio, un análisis de encuestas comunitarias.

No obstante, ignoremos la exageración de la Comisión Europea sobre los niños afectados, ya que la cifra publicada por la OMS sigue siendo muy alta y debe ser abordada.

La cifra publicada por la OMS sugiere que más de 6 millones de niños en la UE sufren abusos sexuales.

En consecuencia, podemos estar de acuerdo en que la UE debe hacer algo para detener el abuso sexual infantil.

2. ¿Puede la vigilancia ayudar a atajar los abusos a menores?

¿Dónde se producen los abusos?

Otra cuestión muy importante a la hora de introducir medidas de vigilancia para atajar los abusos sexuales a menores es la de la eficacia.

Si la vigilancia de nuestras comunicaciones privadas (escaneo CSAM) ayudara a salvar a millones de niños en Europa de los abusos sexuales, mucha gente estaría de acuerdo con la medida. Pero, ¿será realmente así?

En la misma página web en la que la Comisión Europea afirma que “1 de cada 5” niños está afectado, también dicen que “entre el 70% y el 85% de los niños conocen a su abusador. La gran mayoría de los niños son víctimas de personas en las que confían”.

Esto nos lleva a preguntarnos: ¿Cómo va a ayudar el escaneo de CSAM en cada mensaje de chat a prevenir el abuso sexual infantil en la familia, el club deportivo o la iglesia?

La Comisión Europea deja esta pregunta sin respuesta.

¿Cuántas órdenes de vigilancia se refieren a la protección de los niños?

Para saber si la vigilancia de los mensajes privados en busca de material de abuso sexual infantil puede ayudar a atajar los abusos sexuales a menores, debemos echar un vistazo a los datos reales de vigilancia que ya están disponibles.

Como proveedor de correo electrónico con sede en Alemania, disponemos de esos datos. Nuestro informe de transparencia muestra que recibimos regularmente órdenes de vigilancia de las telecomunicaciones por parte de las autoridades alemanas para perseguir a posibles delincuentes.

Se podría pensar que Tutanota, como servicio de correo electrónico cifrado de extremo a extremo y centrado en la privacidad, sería el lugar al que acudirían los delincuentes, por ejemplo, para compartir CSAM.

En consecuencia, cabría esperar que el número de órdenes judiciales emitidas en relación con la “pornografía infantil” fuera elevado.

En 2021 recibimos UNA orden de vigilancia de telecomunicaciones basada en la sospecha de que la cuenta se utilizaba en relación con la “pornografía infantil”.

Esto supone el 1,3% de todas las órdenes que recibimos en 2021. Más de dos tercios de las órdenes se emitieron en relación con el “ransomware”; unos pocos casos individuales en relación con la infracción de derechos de autor, la preparación de delitos graves, el chantaje y el terror.

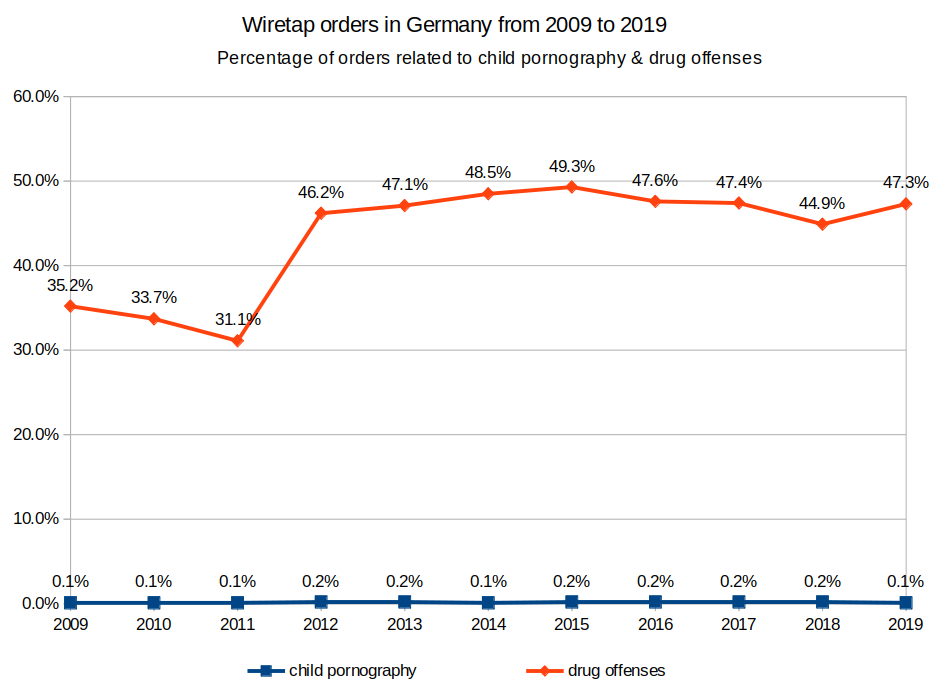

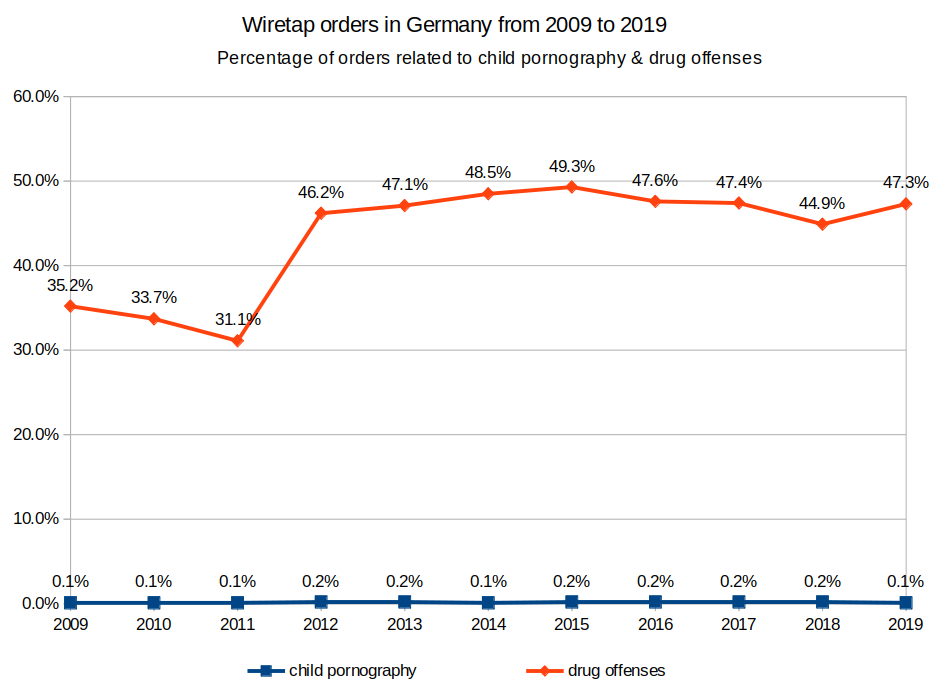

Las cifras publicadas por la Oficina Federal de Justicia de Alemania pintan un panorama similar: En Alemania, más del 47,3% de las medidas de vigilancia de las telecomunicaciones según el § 100a StPO se ordenaron para encontrar sospechosos de delitos relacionados con las drogas en 2019. Solo el 0,1% de las órdenes -o 21(!) en total- se emitieron en relación con la “pornografía infantil”.

En 2019, hubo 13.670 casos de abuso infantil según laestadística del Ministerio Federal del Interior en Alemania.

Si tomamos estas cifras en conjunto, en 2019 hubo 13.670 niños abusados en Alemania. En sólo 21 de estos casos se emitió una orden de vigilancia de las telecomunicaciones.

Se hace evidente que la vigilancia de las telecomunicaciones (que ya es posible) no juega un papel importante para localizar a los agresores.

La conclusión aquí es obvia: “Más vigilancia” no traerá “más seguridad” a los niños en Europa.

3. 3. Europa, ¿un centro para el CSAM?

De forma similar a la afirmación “Uno de cada cinco”, la Comisión de la UE afirma que el 90% del material de abuso sexual infantil está alojado en servidores europeos. Una vez más, la Comisión de la UE utiliza esta afirmación para justificar su planeado escaneo del CSAM.

Sin embargo, incluso los expertos en este campo, la eco-asociación alemana que trabaja junto a las autoridades para retirar el CSAM (Material de Abuso Sexual Infantil), afirman que “en su estimación, las cifras están muy lejos del supuesto 90%“. Alexandra Koch-Skiba, de la Asociación eco, tambiénafirma: “En nuestra opinión, el proyecto tiene el potencial de crear un pase libre para la vigilancia del gobierno. Esto es ineficaz e ilegal. La protección sostenible de los niños y los jóvenes requeriría, en cambio, más personal para las investigaciones y una persecución exhaustiva”.

Incluso los funcionarios alemanes encargados de hacer cumplir la leycritican los planes de la UE a puerta cerrada. Argumentan que habría otras formas de localizar a más delincuentes: “Si sólo se trata de tener más casos y atrapar a más delincuentes, no hace falta semejante intromisión en los derechos fundamentales”, dice otro investigador de abusos a menores con muchos años de experiencia.

Exageración al borde de las fake news

Es increíble que la Comisión de la UE utilice estas exageraciones para inclinar la opinión pública a favor de la exploración del CSAM. Parece que el argumento de “proteger a los niños” se utiliza para introducir mecanismos de vigilancia similares a los chinos. Aquí en Europa.

Pero Europa no es China.

¿Qué se puede hacer?

En Alemania hay al menos una chispa de esperanza. Un documento filtrado sobre el “control del chat ” sugiere que el actual gobierno alemán se opondrá a la propuesta de la Comisión Europea.

Ahora nosotros, como ciudadanos europeos y miembros de la sociedad civil, debemos presionar a los legisladores para que se opongan a una legislación que pondrá bajo constante vigilancia cada correo electrónico y cada mensaje de chat que enviemos.

Y tú puedes hacer mucho para ayudarnos a luchar por la privacidad

-

- Comparte esta entrada del blog para que todo el mundo entienda las falsas afirmaciones de la Comisión de la UE.

-

- Comparte el vídeo de ‘Digitale Gesellschaft ’ para que todo el mundo entienda que esta legislación es completamente desproporcionada y que hay formas mucho mejores de proteger a los niños.

-

- Llama/envía un correo electrónico a tu representante de la UE para hacer oír tu voz: ¡Detenga el escaneo del CSAM en mi dispositivo personal!

¿Qué significa CSAM?

CSAM se refiere a material de abuso sexual infantil, imágenes que muestran el abuso y la explotación sexual de los niños.

¿Quién busca el CSAM?

Varios servicios escanean en busca de material de abuso sexual infantil en sus servidores, por ejemploGoogle. Desde el 6 de julio de 2021, las empresas de la UE también pueden escanear voluntariamente en busca de material de abuso sexual infantil.

¿Qué consecuencias tiene el escaneo de material CSA?

El escaneo del lado del cliente en busca de material CSA convertirá sus propios dispositivos en máquinas de vigilancia. Si el escaneo CSAM se convierte en obligatorio, cada mensaje de chat y cada correo electrónico que haya enviado será escaneado y leído por otros. El escaneo del lado del cliente, por lo tanto, socava su derecho a la privacidad.