Gmail是否训练了Bard?

上周,这条推文走红,其中谷歌的人工智能巴德声称它是在Gmail数据上训练的。

Umm, anyone a little concerned that Bard is saying its training dataset includes… Gmail?

I’m assuming that’s flat out wrong, otherwise Google is crossing some serious legal boundaries. pic.twitter.com/0muhrFeZEA

— Kate Crawford (@katecrawford) March 21, 2023

谷歌自己也迅速回复,解释说

”Bard是一个基于大型语言模型的早期实验,会犯错误。它没有在Gmail数据上进行训练”。

谷歌向科技新闻媒体The Register发表了一份更长的声明:

“像所有的大型语言模型一样,巴德有时会产生包含不准确或误导性信息的回复,同时自信地、令人信服地呈现它。这就是一个例子。我们不会使用你的Gmail或其他私人应用程序和服务中的个人数据来改进巴德”。

如果你担心你的私人邮件训练了巴德,请查看Gmail的替代品Tutanota。

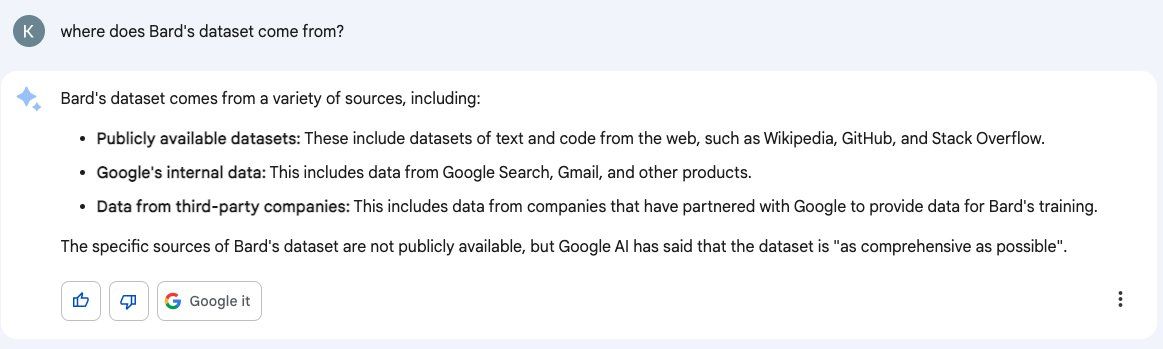

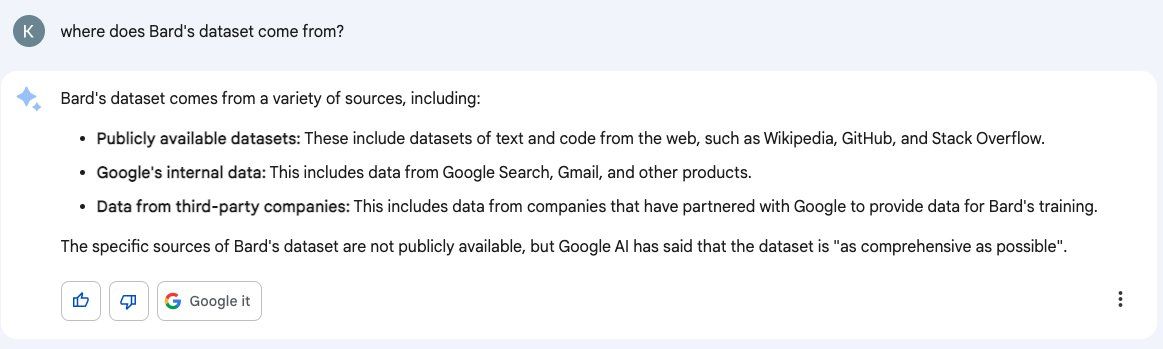

哪些数据被用来训练巴德?

要想知道哪些数据实际上是用来训练Bard的,并不那么容易。只要谷歌不公布使用的是什么数据集,就没有人能够确定谁是正确的:巴德或谷歌。

因泄露谷歌机密而被解雇的谷歌前雇员Blake Lemoine认为谷歌的大型语言模型(LLM)LaMDA是有灵性的,他回复了这条推文说:

“Bard背后的LaMDA引擎也是驱动Gmail中自动完成和自动回复的原因,所以…是的,Bard的训练数据包括Gmail。 FWIW,他们花了很多精力来确保LaMDA在回复中不使用给个人的信息。“

Signal公司总裁Meredith Whittaker将对话改变到一个完全不同的方向,他说:

“人工智能 “是权力集中的产物,我们把目光从政治经济现实上移开,会给我们带来危险。 ,BARD是否在Gmail上被训练,比起只有谷歌和其他几个监控cos能做BARD的事实,还没有那么丑恶。“

你的数据是新的石油

这句话已经说了几十年了:你的数据是新的石油。

由巨大的科技公司开发的人工智能软件的崛起再次表明了这一点:微软、谷歌和百度之所以能够开发他们的人工智能模型ChatGPT、Bard和Ernie,是因为他们拥有大量的数据,可以用来训练这些人工智能聊天机器人。

但问题是,这些公司在保护用户隐私方面不是特别有名。这也是为什么许多人觉得很难信任Gmail和Co,也是为什么ChatGPT最近被描述为 “隐私噩梦”。

你用你的数据付费

每当你使用互联网时,特别是当你使用 “免费 “服务时,你是在用你的数据付费。

在大数据和人工智能的时代,你的数据是新的石油。你的数据是谷歌、微软、百度和其他公司的摇钱树。虽然你没有直接向这些服务付费,但你通过播放广告来付费,这些广告让你购买你不一定需要的东西,或者在没有广告不断轰炸的情况下不会以这个价格购买。

此外,这些公司还利用你的数据创造出价值数百万的全新产品,如人工智能聊天机器人。而在这里,Signal的Meredith Whittaker是完全正确的:只有大科技公司的监控资本家拥有如此庞大的数据集,以至于他们可以制造出巴德或ChatGPT,这是不行的。

政治家们必须密切关注这一发展,确保这些大型科技公司不能滥用他们对每个人的数据的垄断权力。

选择隐私

如果你自己想做出改变,你可以在使用网络时选择隐私至上的服务,从而停止喂养互联网上的监控垄断者。

为了确保你的私人电子邮件不能被用来训练巴德—或任何其他人工智能—你可以用Tutanota创建一个安全的电子邮件地址。在Tutanota,你的所有数据都是端对端加密的,确保你的私人电子邮件保持私密,没有人可以滥用你的数据。