Microsoft Copilot имела доступ к конфиденциальной электронной почте организаций - без разрешения.

Компания Microsoft признала, что ошибка в Microsoft 365 Copilot непреднамеренно предоставляла помощнику искусственного интеллекта доступ к конфиденциальным электронным письмам.

Как сообщает Bleeping Computer, сервисный отчет об ошибке(отслеживается как CW1226324), которая была первоначально обнаружена 21 января, затрагивает функцию чата Copilot “рабочая вкладка”. Это позволяет ему читать и обобщать электронные письма в папках “Отправленные” и “Черновики” пользователя. Что еще более важно, ИИ имел доступ к чтению и обобщению писем, помеченных метками конфиденциальности, которые явно предназначены для того, чтобы автоматические инструменты не имели к ним доступа.

Microsoft подтвердила Bleeping Computer информацию о проблеме:

Чат “рабочей вкладки” Microsoft 365 Copilot обобщает сообщения электронной почты, несмотря на то что на эти сообщения наложены метки конфиденциальности и настроена политика DLP”.

Технологический гигант из Кремниевой долины также сообщил, что “проблема в коде позволяет элементам в папках “Отправленные” и “Черновики” подхватываться Copilot, даже если на них установлены конфиденциальные метки”. Microsoft подтвердила, что начала распространять исправление этой ошибки в начале февраля. В среду Microsoft заявила, что следит за развертыванием и обращается к некоторым пользователям, чтобы убедиться, что исправление работает.

Использование Copilot для повышения производительности не стоит риска

Microsoft продвигает внедрение своего искусственного интеллекта Copilot во все приложения Microsoft 365 - не только для личного использования, но и для компаний, чтобы интегрировать его в рабочую силу. В сентябре 2025 года Copilot Chat, чат на базе ИИ от Microsoft, который позволяет пользователям взаимодействовать с агентами ИИ, был внедрен в Excel, Word, Outlook, PowerPoint и OneNote для бизнес-клиентов Microsoft 365. И вот, спустя всего четыре месяца, ошибка скомпрометировала конфиденциальные данные пользователей Microsoft 365.

Несмотря на то что технологические гиганты предлагают использовать ИИ-помощников, таких как Copilot Chat, для повышения продуктивности и ускорения рабочих процессов, очевидно, что новые и развивающиеся технологии ИИ могут стать угрозой безопасности и конфиденциальности - особенно для организаций, которым необходимо защищать конфиденциальную информацию.

Рост цен, искусственный интеллект и одна плохая ошибка: Прощай конфиденциальность электронной почты!

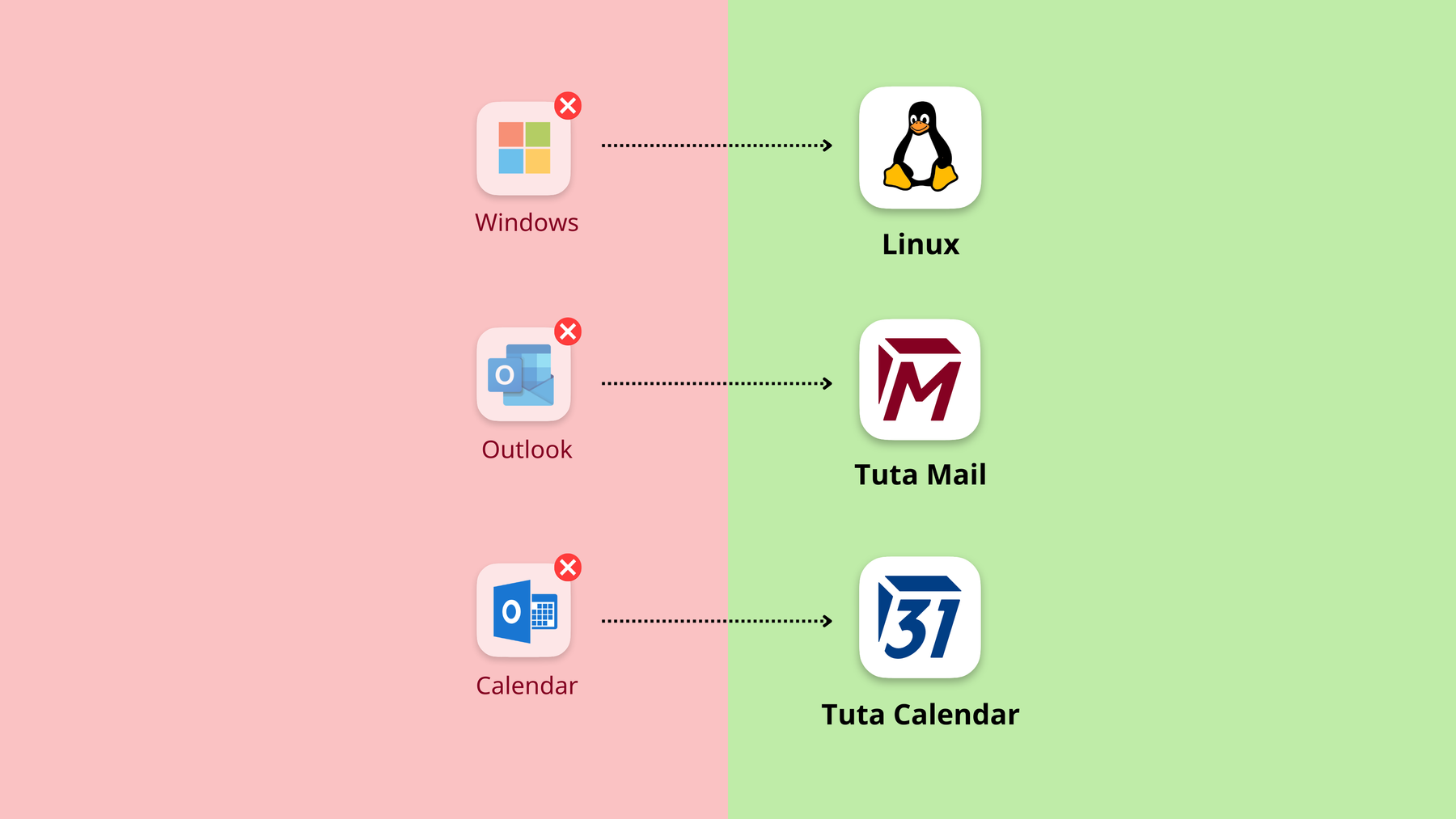

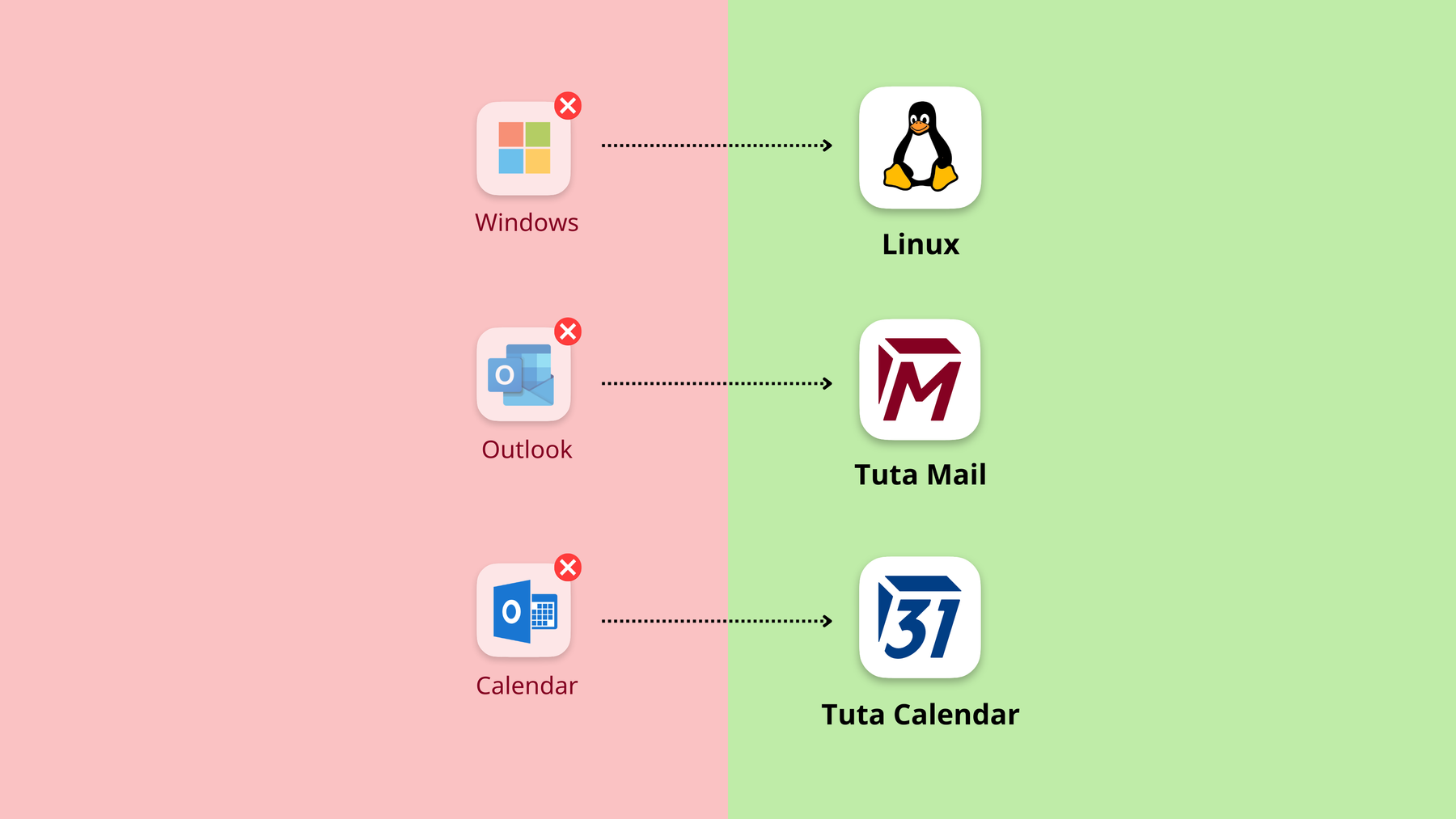

Сегодня многие компании используют Microsoft Outlook - в основном потому, что он входит в комплект поставки таких инструментов Microsoft Office, как Word и Excel. Однако последние события показывают, что переход на альтернативные решения, особенно для работы с электронной почтой, становится все более привлекательным.

-

В январе 2026 года ошибка позволила чату Copilot Chat обобщать электронные письма, несмотря на настроенные метки чувствительности и политики DLP.

-

В 2025 году Microsoft объявила о значительном повышении цен на Microsoft 365, которое начнется в июле 2026 года.

-

В сентябре 2025 года Microsoft внедрила Copilot Chat в Excel, Word, Outlook, PowerPoint и OneNote для платных бизнес-клиентов Microsoft 365.

Из всего этого становится ясно одно: Если ваш бизнес использует Microsoft 365, пришло время отказаться от привязки к поставщику и защитить конфиденциальную информацию. К счастью, существуют отличные альтернативы продуктам Microsoft.

Пришло время отказаться от привязки к поставщику

Это не первая и не последняя проблема безопасности, с которой столкнулась Microsoft.

-

В 2024 году правительство США попросило Microsoft внести исправления в систему безопасности, прежде чем добавлять новые функции, после того как Китай взломал почтовые серверы Microsoft.

-

В 2025 году компании предупредили, что не стоит переходить на “Новый Outlook”, так как он не соблюдает законы о защите данных, которые должны соблюдать предприятия.

-

В 2025 году Microsoft запустила тенденцию европейского цифрового суверенитета, после того как адвокат Microsoft во Франции подтвердил, что все данные, размещенные в Microsoft, даже если они хранятся в европейских дата-центрах, могут быть доступны правительству США - без предупреждения.

С учетом интеграции и быстрого развития Copilot в Microsoft 365, данные частных лиц и организаций по-прежнему будут подвергаться риску.

Обнаружение этой ошибки спустя всего несколько месяцев после внедрения Copilot в бизнес-планы Microsoft 365 подчеркивает, почему помощникам искусственного интеллекта не место в электронной почте и важно использовать электронную почту со сквозным шифрованием, например Tuta Mail.